Ingen av de här personerna finns i verkligheten. De har skapats av datorer, utan mänsklig medverkan. Nu varnar experter för att metoden kan användas för att göra nya typer av falska nyheter.

Vi är skapade av AI

Falska porträtt kan skapas med en knapptryckning på sidor som thispersondoesnotexist.com. Bilderna genereras av en kraftfull AI-algoritm som kallas GAN (Generative Adversarial Networks).

Det här är en artikel från 2019.

På bara några år har tekniken för att skapa realistiska porträtt utvecklats enormt tack vare en metod inom artificiell intelligens, AI, som går under namnet GAN – generative adversarial networks.

Tekniken uppfanns för knappt fem år sedan av forskare vid University of Montreal i Kanada. Då lyckades algoritmen bara åstadkomma suddiga, svartvita porträtt. Men utvecklingen har gått snabbt och AI-forskare över hela världen har nu anammat GAN.

– Man kan tala om ett teknikgenombrott när det gäller att generera bilder med hjälp av AI, säger Fredrik Heintz, docent i datalogi vid Linköpings universitet.

Djupa neuronnät tävlar mot varandra

GAN bygger på det som inom maskininlärning kallas för djupa neuronnät. Denna typ av AI används för att lära datorer att till exempel känna igen vad en bild föreställer. För att bli bra på uppgiften måste dock neuronnätet först träna på stora mängder bilder med känt innehåll, något som kräver en hel del mänsklig hjälp.

Med GAN går det att få datorn att själv generera bilder av ansikten som i exemplet ovan. Tricket är att använda två neuronnät som tävlar mot varandra. Båda tränas i att känna igen ansikten med hjälp av äkta bilder. Sedan skapar det ena nätverket – generatorn – ett påhittat ansikte. Det andra, som kallas för diskriminatorn, försöker sedan avgöra om bilden är äkta.

– Jag brukar likna det vid förfalskare som försöker skapa falska sedlar och polisen som försöker avgöra om en sedel är äkta eller falsk. När polisen blir bättre tvingar det förfalskarna att bli bättre och tvärtom. På så sätt kan du få ett system som med relativt lite träningsdata kan lära sig själv genom att i praktiken skapa egna träningsdata, säger Fredrik Heintz.

Fejkade ansikten och röster som inte finns

Film- och spelindustrin har länge arbetat med specialeffekter där till exempel en skådespelares ansikte sätts på en annan kropp. Det har dock varit ett svårt och tidskrävande arbete att pussla ihop bilderna, men tack vare AI kan allt mer av jobbet utföras av datorer. Det som tidigare krävde expertkunskap kan i dag göras med datorprogram som är tillgängliga på nätet. Redan för ett år sedan kunde till exempel Forskning & Framsteg rapportera om en app som gör det möjligt att byta ut ansikten i videofilmer. På internet finns mängder av exempel på sådana så kallade deepfakes. Sök till exempel på deepfakes och skådespelaren Nicolas Cage, så hittar du mängder av exempel där han förekommer i filmer som han aldrig varit med i.

Men med GAN och andra liknande AI-metoder stannar möjligheterna inte vid att byta ut ansikten. Snabba framsteg görs för att skapa syntetiska röster som är kopior av en verklig persons röst. Forskare vid University of Washington i USA kunde redan för två år sedan visa hur en ljudfil kan förvandlas till läpprörelser som matchar talet.

En ögonöppnare kom förra året i form av en film där USA:s förre president Barack Obama förolämpar den nuvarande presidenten Donald Trump. I själva verket tillhör rösten en känd komiker. Ett annat uppmärksammat exempel kommer från den senaste filmgalan Golden Globe, där en skådespelares ansikte bytts ut mot ett annat med förbluffande bra resultat.

Rörelser flyttas från en person till en annan

Även rörelser kan flyttas från en person till en annan. Forskare vid amerikanska Berkeley har använt GAN för att skapa filmer där rörelserna hos professionella dansare överförs till vanliga personer.

Än så länge krävs en hel del arbete och kunskap för att skapa den här typen av filmer och tekniken är heller inte helt perfekt. Suddiga konturer eller till och med ett extra öga gör att det är uppenbart att bilden inte är äkta.

Men på sikt är möjligheterna stora – inte bara inom spel- och filmindustrin. Det finns mängder av användningsområden för AI som kan skapa egna realistiska varianter av bilder som den matats med.

Självkörande bilar tränas med GAN

Ett är att låta dem skapa träningsdata för andra AI-system. I självkörande bilar används till exempel AI för att känna igen objekt och olika situationer. Systemet måste då först tränas med massor av exempel på bilder som föreställer människor, cyklar, barnvagnar och annat som kan dyka upp på och vid sidan av vägen. Med GAN går det att generera stora mängder träningsdata som i vissa fall kan vara svåra att hitta på annat sätt, som bilder på bilolyckor. Inom det medicinska området skulle det kunna vara bilder på tumörer.

Det finns mängder av andra tillämpningsområden. Inom skolundervisning skulle det gå att återuppliva historiska personer, som själva får berätta om viktiga händelser i sina liv. Och forskare vid bland annat University of California i USA har använt GAN för att skapa tandkronor utifrån en skannad bild av käken med den saknade tanden.

Musik och konst skapas med AI

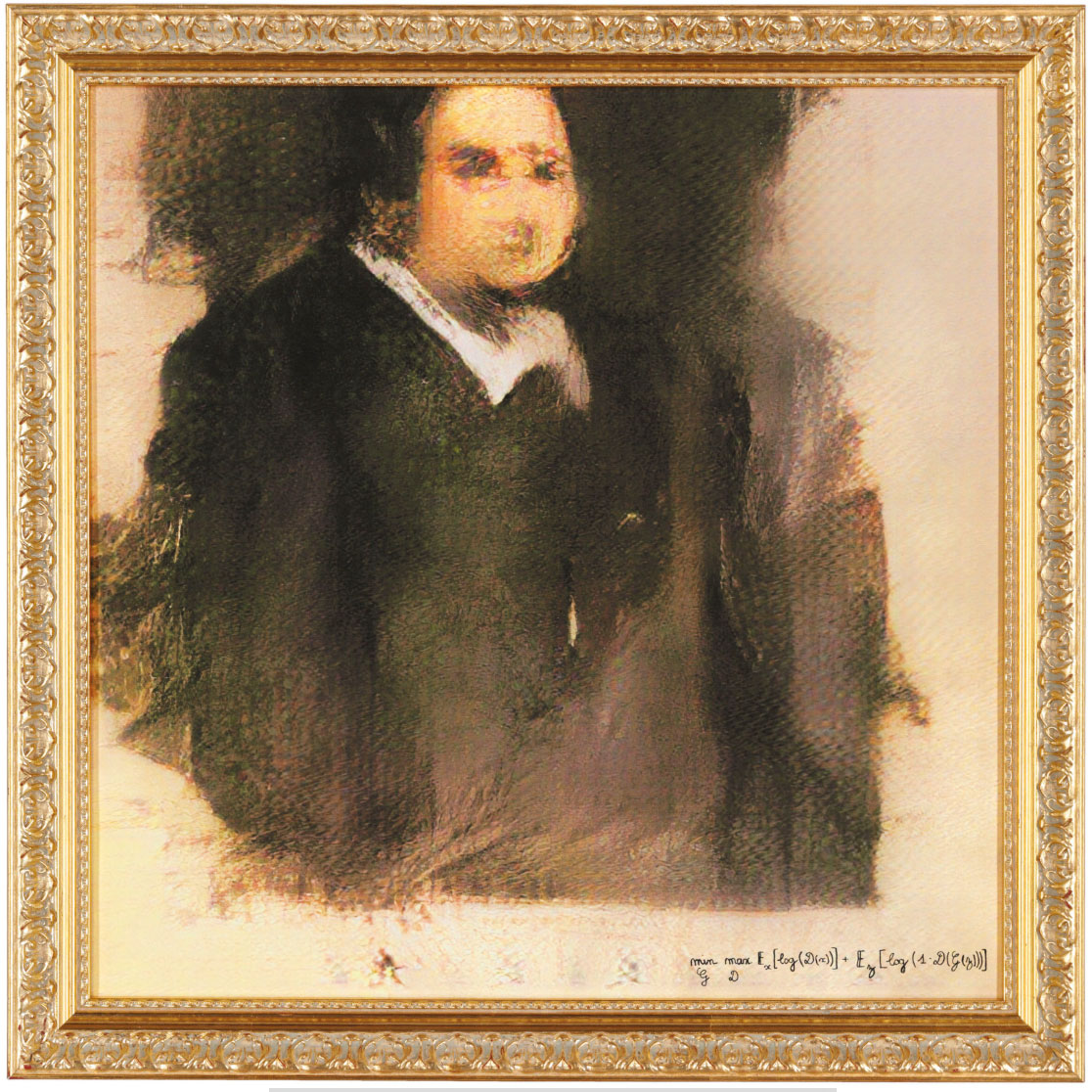

Datorer kan också skapa musik och konst. I slutet av oktober såldes för första gången ett AI-genererat konstverk på auktionshuset Christie’s i New York. Tavlan, som föreställer ett ofärdigt porträtt av en ung man, såldes för hela 432 500 dollar. Bakom tavlan står ett franskt konstnärskollektiv, som använde GAN matad med bilder på 15 000 verkliga tavlor från 1300-talet fram till 1900-talet, för att skapa det datorgenererade porträttet.

Men som med de flesta kraftfulla tekniker kan det också missbrukas. Om röster, ansikten och rörelsemönster kan bytas ut i filmer, utan att det knappt syns, skapar det oanade möjligheter för att sprida falska budskap.

Svårt att avgöra sant och falskt

Stefan Larsson, docent i teknik och social förändring vid Lunds tekniska högskola, forskar om etik- och ansvarsfrågor kring digitalisering. Han frågar sig vad som händer om vi börjar ifrågasätta autenticiteten hos alla bilder och filmer vi ser.

– Kan vi lita på att det verkligen är statsministern vi ser på en video och att han faktiskt har sagt det vi hör att han säger? Än är vi inte där, men det är en utveckling som vi måste bevaka noga.

Han är inte ensam om att höja ett varningens finger. Forskare vid amerikanska University of Maryland har listat en rad tänkbara sätt som GAN och andra tekniker skulle kunna utnyttjas på för onda syften.

En falsk porrvideo skulle kunna användas i utpressningssyfte eller spridas för att förstöra någons rykte. Även om den som utsätts för den falska ryktesspridningen kan bevisa att det som filmen visar aldrig har inträffat, kan skadan redan vara skedd. Falska filmer i omlopp kan till exempel göra det svårare att få jobb.

Äkthetsmärkning kan stävja falska nyheter

Problemet med påhittade nyheter riskerar att eskalera. Filmer där politiker gör eller säger saker som de aldrig har gjort kan påverka allmänhetens förtroende och påverka demokratiska val. Detta är något som redan debatteras i USA. I ett brev till chefen för USA:s underrättelsetjänst varnade i höstas tre kongressledamöter för att främmande makt kan komma att utnyttja falska filmer för att påverka kommande val. GAN och andra AI-tekniker beskrivs som nästa vapen i desinformationskriget.

Uppfanns 2014

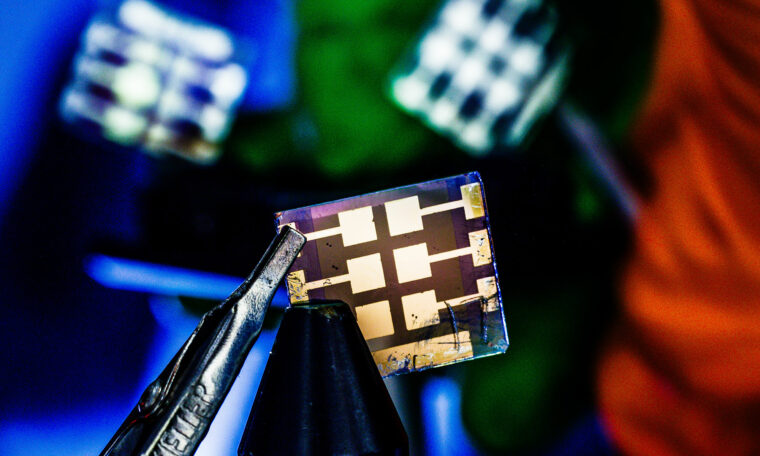

- Tekniken som gör det möjligt att skapa falska porträtt kallas GAN – generative adversarial networks.

- Tekniken uppfanns 2014 av forskaren Ian Goodfellow vid University of Montreal i Kanada något som gett honom smeknamnet ”the Ganfather”.

- När han presenterade tekniken kunde den bara åstadkomma suddiga, svartvita porträtt.

- Sedan dess har tekniken utvecklats enormt. I december förra årets presenterade forskare vid det amerikanska företaget Nvidia en forskningsrapport där tekniken utvecklats så att den skapar fotorealistiska porträtt av falska människor.

- Här kan du se en film om tekniken.

En lösning är att införa någon typ av äkthetsmärkning av filmer som läggs ut på olika plattformar på internet. Forskare jobbar med olika tekniska metoder för att upptäcka att en video manipulerats. Det kan handla om att personen inte blinkar med ögonen på ett normalt sätt eller att ljuset inte faller korrekt.

Men samtidigt som forskare blir bättre på att upptäcka vad som är äkta och vad som är falskt blir verktygen för att skapa falska bilder allt vassare. I den här katt-och-råttaleken riskerar de som ska rensa bort de falska filmerna att hamna på efterkälken.

Lagstiftning är en annan väg att gå. Australien har till exempel infört nya lagar mot spridning av bilder med sexuellt innehåll, sedan en kvinna trakasserats med falska bilder.

– AI har kommit till ett stadium där det inte längre bara är en datavetenskaplig fråga, utan en samhällsfråga, där jurister, samhällsvetare och humanister behöver studera konsekvenser och inte minst politiker behöver vara med och diskutera vilka lagar och etiska riktlinjer som ska gälla, säger Stefan Larsson.

Prenumerera på Forskning & Framsteg!

10 tidningsnummer om året och dagliga nyheter på fof.se med kunskap baserad på vetenskap.