Bild: Björn Öberg

Kan vi skapa intelligens?

Vissa forskare menar att det är omöjligt att skapa maskiner som är lika intelligenta som vi människor. Andra tror att det bara är en fråga om tid – och att nästa steg blir att maskinerna börjar tillverka ännu smartare maskiner, och så vidare. Vad händer med oss människor då?

Vad är singularitet? frågar jag Siri, röstfunktionen i min telefon. Och får tillbaka en definition från brittiska Wikipedia: ”Den teknologiska singulariteten är en teoretisk framtida tidpunkt karakteriserad av teknologiska framsteg utan motstycke, delvis orsakade av maskiners förmåga att förbättra sig själva genom artificiell intelligens.”

”Vad tycker du om det?” frågar jag Siri.

– Jag föredrar att inte svara, säger hon.

För tre år sedan dök Siri upp i min telefon, femton år efter att schackdatorn Deep Blue hade slagit Gary Kasparov i schack och några månader efter att datorsystemet Watson vunnit kunskapsspelet Jeopardy. System med artificiell intelligens, AI, har under det senaste årtiondet blivit häpnadsväckande duktiga på allt från översättningar mellan godtyckliga språk till förarlösa bilar. Maskiner som förstår omvärlden och tar egna beslut har nu klivit ut från filmduken och blivit verklighet.

Inom vissa områden har den artificiella intelligensen redan överskridit den mänskliga med råge. Frågan är om maskinerna kan bli som vi. Och om det händer, vad ska då hindra dem från att bli ännu smartare, ända tills de inte längre har något behov av sina skapare?

Varningarna har duggat tätt under den senaste tiden: superintelligensen är nära, och efter det kan det bara gå utför för oss människor. När maskinintelligensen överstiger vår, inträffar singulariteten då människan i bästa fall blir överflödig, i värsta fall utplånad.

”Jag tror att fullt utvecklad maskinintelligens skulle kunna innebära slutet för mänskligheten”, sade kosmologen Stephen Hawking häromveckan med sin speciella datorstämma. ”Utvecklad AI är det största hotet mot vår existens”, har entreprenören och IT-miljardären Elon Musk sagt. Bill Gates håller med.

Vet de något som vi inte vet? Att det är ett område som flödar av spekulationer och där åsikterna går starkt isär är kanske onödigt att säga. Vad ska man tro?

Själva begreppet singularitet dök upp första gången 1965, då matematikern Irving Good spekulerade om en teknologisk singularitet som skulle bli den sista uppfinningen som människan någonsin behöver göra. År 1993 populariserades singulariteten av Vernor Vinge, datavetare och science fiction-författare, som förutspådde att vi inom trettio år kommer att ha de teknologiska medel som krävs för att skapa supermänsklig intelligens. Kort därefter kommer den mänskliga eran att ta slut. I dag förknippas Ray Kurzweil, numera teknisk chef på Google, mest med idén om singularitet som mänsklighetens väg till odödlighet.

– I stället för singularitet föredrar jag en mer precis term – intelligensexplosion – som innebär en mycket snabb övergång till superintelligens, säger filosofen Nick Bostrom. Han leder Future of humanity institute vid University of Oxford, där han ägnar sig åt frågan om mänsklighetens chanser att överleva på lång sikt.

Superintelligensen är vår framtid, menar han. Men vi kommer att lämna våra hem, att erövra kosmos. Kanske måste vi då också lämna våra kroppar.

– Jag tycker inte att biologi spelar en speciellt central roll för mänskligheten. Våra erfarenheter, drömmar, tankar, minnen och känslor kan i princip kopplas bort från den biologiska kroppen.

Spelar vi våra kort rätt, har vi en chans att överleva. Men det kan också hända att vi av misstag ger den första superintelligenta varelsen mål som leder till att människan utrotas. Ett enkelt exempel skulle kunna vara en maskin som tillverkar pappersgem. En sådan maskin behöver kanske inte vara särskilt smart, men den gör allt för att uppnå sitt mål, skaffar sig alla tillgängliga resurser och, om människans intressen står i vägen, tar maskinen ingen hänsyn.

Därför ska vi tänka efter före, och Nick Bostrom och hans kolleger lägger all kraft på att grubbla över hur de existentiella riskerna kan undvikas. Det gäller att den framtida superintelligenta maskinen ärver människans bästa sidor, och glömmer de farliga.

Det önskar även flera hundra namnkunniga personer som signerat ett öppet brev om att göra AI-systemen inte bara mer kapabla, utan även till gagn för mänskligheten. Initiativtagarna till det öppna brevet startade även The future of life institute under ledning av svensken Max Tegmark, som också är professor i fysik vid MIT. Flera liknande institut ägnar sig åt AI-frågorna: förutom Nick Bostroms Future of life institute i Oxford, finns även Cambridge center for existential risk, lett av astronomen Martin Rees, samt Machine intelligence research institute (fram till 2013 kallat Singularity institute) under ledning av en ung datavetare och entreprenör, Eliezer Yudkowsky. Flera framgångsrika uppfinnare och numera IT-miljardärer, som Elon Musk, James Martin, Jaan Taallin och Peter Thiel, har satsat stora summor på dessa institut för forskning om vår superintelligenta framtid.

Vad är det då som har hänt inom själva AI-forskningen, som får en del att se optimistiskt på framtiden, och andra pessimistiskt? Kortfattat kan man säga ökad datorkraft kombinerad med sofistikerade matematiska metoder och förfinad statistisk behandling av stora mängder data.

– En stark trend i dag är utvecklingen av autonoma system, som självkörande bilar. Det tekniska framsteget här är en laser som mäter avstånd och kan ge en bra förståelse av omvärlden i tre dimensioner. Det blir oerhört mycket data när alla laserpunkter från bilens omgivning ska sättas samman och bearbetas, samtidigt som fordonet rör sig framåt, berättar Fredrik Heintz, forskare vid Linköpings universitet och ordförande i svenska AI-sällskapet.

En annan dominerande trend är maskininlärning – att kunna dra slutsatser från stora mängder bakgrundsdata, som i automatöversättning eller att systemet lär sig känna igen naturligt språk, bilder och föremål.

Själva namnet artificiell intelligens, AI, myntades 1956 av MIT-forskaren John McCarthy under en konferens vid Dartmouth college i USA, då även själva forskningsfältet skapades. På den tiden hade man en föreställning om att en modell av tankevärlden kunde skapas i en dator, enbart med hjälp av logik och matematiska symboler.

Att tänka sågs som en logisk slutledningsförmåga: om du vet att fåglar kan flyga och att koltrast är en fågel så blir slutsatsen att koltrastar kan flyga. Sådana logiska samband kunde sedan formaliseras, tänkte man sig, och användas som grund för tänkande maskiner.

Men tankeverksamheten visar sig vara mer komplicerad än så, och för det mesta är inget i världen helt säkert, och mycket är oklart. Inte alla fåglar kan flyga, och bland dem som inte kan måste man kunna skilja mellan dem som är skadade och dem som sitter i bur, och mellan en koltrast och en pingvin. Sådant som till och med små barn lätt kan se skillnad på visade sig nästan oöverstigligt för datorsystemen.

I slutet av 1990-talet kunde dock nytt liv blåsas i AI-forskningen. Växande datorkraft tillät maskinerna att lära sig på ett nytt sätt genom att själva dra slutsatser från stora mängder data som de matades med.

En dator kan exempelvis förses med en massa bilder och lära sig känna igen mönster. Algoritmerna bygger bland annat på probabilistisk programmering, som kombinerar logiken med statistiska metoder. Ursprunget kan sökas ända tillbaka till 1700-talet, då matematikern Thomas Bayes utvecklade den statistik som i dag kallas bayesiansk. Den kan hantera osäker information, och utgången ändras allt eftersom sannolikheterna för olika variabler ändras.

– Ett exempel är att om den vanligaste bilfärgen är grå, så är det kanske 50 procents chans att du har en grå bil, 25 procents chans att den är vit, 10 att den är röd … Men om jag får reda på att din bil är ljus – då ändras sannolikheterna. Det är sådant som går att behandla med bayesiansk statistik, säger Fredrik Heintz.

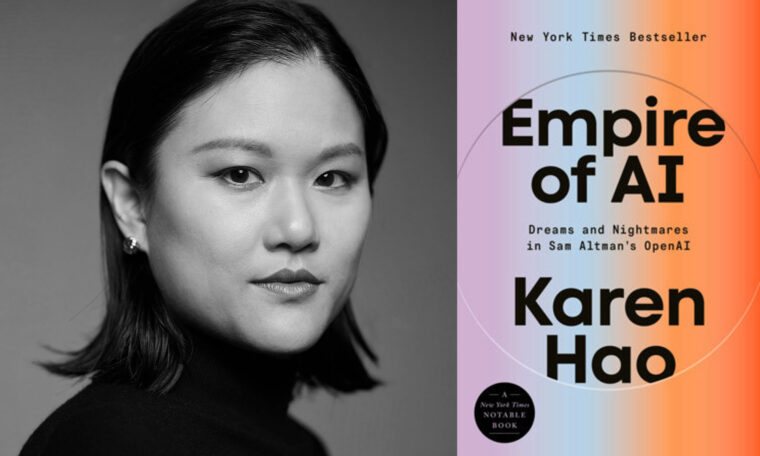

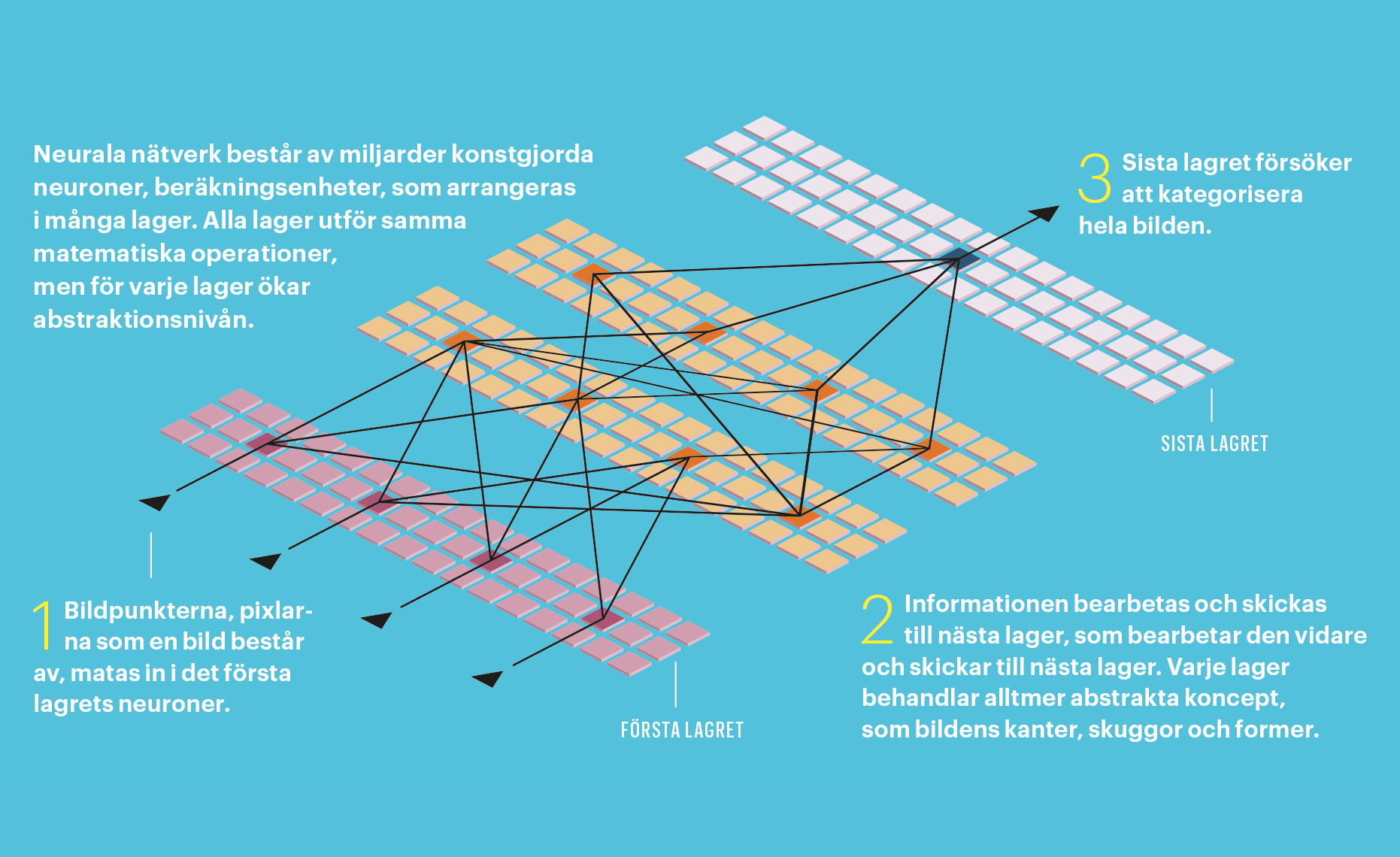

Så tolkar ett neuralt nätverk en bild.

Bild: Johan Jarnestad

Eller det här med fåglarna: Om datorn först får veta att en pingvin är en fågel, så drar den slutsatsen att den nog kan flyga. Men om datorn i nästa steg får reda på att pingvinen väger 30 kilo, så blir slutsatsen att den nog inte kan flyga.

Den probabilistiska maskininlärningen bygger alltså på tidigare kunskaper, och därmed går den till väga på liknande sätt som vår egen kunskapsuppbyggnad. Systemet skapar själv regler för de kunskaper som var svåra att programmera in från början.

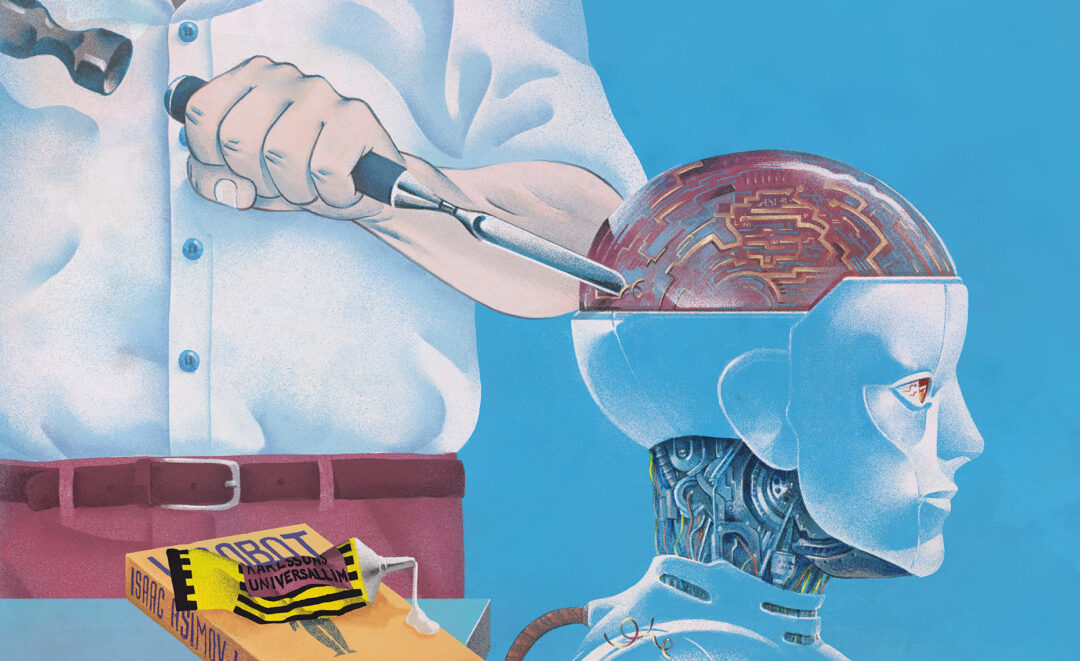

Många system använder neurala nätverk, en flera årtionden gammal teknologi som slog världen med häpnad när den började utvecklas inom AI på 1950-talet. Tanken var att simulera hjärnans sätt att tänka enligt den gamla metaforen för hjärnan som en dator. Konstgjorda nervceller, neuroner, används då som beräkningsenheter. Från början kunde nätverket bestå av upp till några hundra neuroner, oftast i bara en eller ett par nivåer. Numera är de miljarder och arrangerade i många nivåer (antalet nervceller i en mänsklig hjärna uppskattas till cirka 130 miljarder).

– Det är svårt att ge en exakt bild av vad varje nivå eller neuronlager betyder, vilket är en typ av kritik mot de neurala nätverken – att de inte kan förstås av människor. Man skulle kunna säga att varje lager ger en mer abstrakt tolkning av den ursprungliga informationen. Men matematiskt är varje lager likadant som det föregående; skillnaden är vilken input det får. De första genombrotten för den tekniken var att kunna klassificera bilder, ljud och handskrift, säger Fredrik Heintz.

En av de främsta poängerna med neurala nätverk är att de kan tränas. Ska ett system kunna känna igen fåglar måste det först matas med mängder av bilder, både på fåglar och på annat. Om bilderna är märkta från början, kan maskinen själv hitta mönstret och formulera regler för vad som kännetecknar en fågel. På samma sätt kan algoritmerna för maskininlärning inte bara lära sig känna igen bilder, utan även olika begrepp, egenskaper och särdrag som vi förstår men har svårt att definiera exakt.

– Nackdelen med vanliga neurala nätverk är att det inte finns någon teori om hur många lager och hur många neuroner som krävs. Det är i princip vad den senaste trenden inom AI-forskningen – djup inlärning – handlar om.

Djupet i den djupa inlärningen kan också beskrivas som att det neurala nätverket består av många många fler lager än hittills. Tidigare neurala nätverk med få lager kunde bara hantera specifika uppgifter, men nu har nätverken vuxit och med internet sitter i dag de stora företagen på nästintill skrämmande datamängder. Det blir en skola för AI-maskinerna som imponerar allt mer genom sin förmåga att hitta och tolka relevant information.

Forskning om djup inlärning kommer att leda till nya tillämpningar av AI. Mycket är redan i gång. Förra året demonstrerade Microsoft ett system för röstigenkänning som i realtid översatte tal från engelska till tyska. Företaget hoppas kunna bygga in tjänsten i internettelefoni som Skype. Ungefär samtidigt visade Google upp en dator som efter att ha sett miljoner YouTube-bilder lärde sig själv att skilja ut vad den såg, som katter eller mänskliga ansikten, utan att någon taggat bilderna i förväg. Och Facebook har en algoritm kallad DeepFace, som nästan felfritt kan känna igen ansikten på bild, även om de delvis är skymda eller illa belysta, ungefär lika bra som en människa kan.

AI har alltså de senaste åren blivit en framgångssaga som få vågar ifrågasätta. En av de enstaka kritiska rösterna inifrån Silicon Valley tillhör Jaron Lanier, virtual reality-pionjären. Inget ont sagt om själva teknologin, den är fantastisk, menar han. Men han störs av de utopiska framtidsbilderna och den, som han anser, religiösa ideologi som omger AI-forskningen.

”Visdom är inte något som AI med sina statistikprogram kan uppdaga”, menar Jaron Lanier. Den kommer inte från mänskligheten i sig, utan från insiktsfulla kreativa individer. Ingen AI-maskin i världen hamnar i närheten av sådana förmågor. Däremot degraderar AI-kulturen de humana värden som vi vårdar mest och omdefinierar vad det är att vara människa. Som de som skryter om tusentals vänner på Facebook. De kan bara säga så, eftersom de omdefinierar själva begreppet vänskap.

I sina skrifter talar Jaron Lanier om cybertotalitarismen, eller rent av fascismen, som han kallar det han tycker sig se i och runt AI-världen. Vi litar gärna på datorerna och vilseleds av AI-systemens förmåga att genomskåda oss. I stället för att vara kritiska blir vi lättmanipulerade, menar Jaron Lanier. Ta till exempel filmuthyraren Netflix. Vill du se en särskild film, hittar du den nästan säkert inte där. I stället kommer Netflix med förslag, som bygger på dina tidigare val, på andra filmer du ska se. Så ser du dem i stället, och lämnar ifrån dig initiativet. När det gäller Netflix är det hela ganska oskyldigt, film är ju till för att skapa illusioner. Men tänk på alla andra som utnyttjar de spår du lämnar efter dig på internet för att sko sig genom marknadsföring och rikta personanpassad reklam till dig, varnar Jaron Lanier. Allt handlar bara om ren kommers.

– Det är alltid nyttigt att vara kritisk, säger Fredrik Heintz. Kom ihåg att om du inte betalar så betyder det att du säljer dig själv – det är du själv som är varan. Med din telefon och dator ger du bort data hela tiden. Vissa företag, som Google eller Facebook, vill lära känna dig, de lever på att sälja information om dig till andra.

Storföretagen tjänar sina pengar genom att plocka all sin information gratis från nätet, och omvandla den till guld, menar Jaron Lanier. Som översättningsprogrammen – deras framgång bygger på miljontals arbeten som redan gjorts av människor av kött och blod. Det är där, i det förflutna, som systemets verkliga intelligens ligger, inte i framtiden.

Med råkraft, big data och statistikprogram vet storföretagen alltså mer om oss – våra preferenser och val – än vi själva verkar känna till. Men vad har detta med maskinintelligens att göra?

– Ingenting. För vad skulle det betyda att en maskin är intelligent? Att klara ett IQ-test är jättelätt för en maskin. För även om många tror det, så testar ett intelligenstest inte intelligensen, säger Peter Gärdenfors, professor i kognitionsvetenskap vid Lunds universitet.

Han berättar att han ofta får frågan om hur intelligenta djur är. De är ju intelligenta, men de skulle aldrig klara ett intelligenstest. Hur går det ihop?

– Det enda svaret är att intelligens inte är ett generellt begrepp. I stället kan vi tala om problemlösningsförmåga. Vi människor klarar av många praktiska problem; vi är väldigt flexibla, har lyckats befolka jordens alla hörn. För mig är det ett tecken på intelligens. Å andra sidan har alla djur sina sätt att lösa problem. Titta bara på orangutanger, som är fantastiska klättrare, eller fladdermössen med sin spatiala förmåga – de har bägge specialförmågor som vi inte har en chans att uppnå. Så vad skulle det betyda att en robot är intelligent?

Man har alltså betonat intelligensen, men inte till exempel motivationen, vad det är som driver oss. Motivation är något som människan har, inte en robot. Vad skulle det betyda om en robot skulle vilja tömma världen på all materia som krävs för att göra pappersgem, som Nick Bostrom talar om?

– Vi vet inte. Evolutionen har gett oss motivation, men hur det går till har vi ingen aning om. Om vi får autonoma robotar som klarar sin egen energiförsörjning och kan reproducera sig, blir det fråga om att konkurrera med människan om resurser. Det handlar inte om intelligens.

Nej, dagens datorer kan utföra vissa avgränsade uppgifter, men att fråga om de kan tänka är som att fråga vilken färg siffran 3 är, för att citera Ludwig Wittgenstein. En nonsensfråga, alltså. Men det finns en vida spridd förhoppning om att det i princip borde gå att bygga en maskin som gör allt som en mänsklig hjärna kan göra. Neurala nätverk ses som ett steg i den riktningen.

– Vi har ingen modell för hjärnan. Men vi vet att neuronerna i sig är mycket komplicerade med många beståndsdelar. Dessutom innehåller hjärnan så mycket mer än neuroner – neurotransmittorer, kemiska substanser och annat som vi inte har en aning om hur de fungerar i samspel. Förmodligen är det helt fel att ens säga att hjärnan är en maskin. Liknelsen mellan hjärnan och en dator fungerar inte, påpekar Peter Gärdenfors.

Vi är alltså inga tänkande maskiner. Det ska dock inte tolkas som att det finns en särskild tänkande substans i hjärnan. Det är inte aktuellt att återvända till Platons uppdelning i en materie- och en idévärld eller Descartes tudelning i kropp och själ. All hjärnforskning tyder på att hjärnan inte är något annat än materia ordnad på ett särskilt sätt. Men hur?

Ett sätt att komma runt detta är att bortse från definitionerna. För även om man kanske inte vet exakt vad intelligens är, så vet man att det är något som hjärnan har. Så strunta i innehållet, tänk på funktionen – det räcker att maskinen verkar smart.

Så resonerade redan Alan Turing, upphovsmannen till den traditionella datorn, när han 1950 formulerade principen för att bedöma maskinens intelligens med vad som sedan har kallats Turingtestet. Ifall man tror att man pratar med en människa när man i själva verket konverserar med en dator, har denna uppnått mänsklig intelligensnivå. Nu hade Turing faktiskt inte tänkt sig att testet skulle fastställa att en maskin kan tänka – den frågan tyckte han var helt absurd. Om datorn klarade testet innebar det bara att den skulle betraktas som en tänkande maskin, inte att den faktiskt var det. I princip var Turings idé att medvetandet är som ett datorprogram, och datorprogrammet kan beskrivas i termer av input och output. Oavsett vad som finns inne i den svarta boxen, är det funktionen, beteendet, som är avgörande.

I AI-världen kallas detta för funktionalism. Det påminner om psykologins behavioristiska idéer. I dag skulle många hävda att människans beteenden inte går att förklara utan att ta hänsyn till hennes inre liv, med tankar, känslor och upplevelser. För att inte nämna hennes historia och omgivning. Hon är en medveten varelse, medan en maskin och dess algoritmer lika lite nu som någonsin förut vet vad den gör.

– En maskin kan inte vara intelligent, eftersom intelligens förutsätter medvetande. Och en dator är inte medveten. Siri, och alla andra datorer, förstår inte meningen i det du säger och inte heller begriper den sina egna svar. En dator manipulerar bara symboler utan att förstå innebörden av dem, säger John Searle, 83-årig filosofiprofessor vid Berkeley university i Kalifornien.

Redan 1980 gav han sig in i AI-debatten med ett numera berömt tankeexperiment som kallas det kinesiska rummet. I ett tänkt rum finns en engelsktalande person som har fått instruktioner om hur hon ska para ihop meddelanden på kinesiska med lämpliga svar på kinesiska. Hon hanterar alltså språket, men förstår ingenting av själva kommunikationen. Det är Searles sätt att visa att datorer faktiskt saknar det som i filosofin kallas intentionalitet; de begriper inte vad som är meningen med deras utsagor.

– Det enfaldiga med Bostroms resonemang är att tro att eftersom maskinen verkar bete sig intelligent så är den det. Men slutsatsen följer ju inte av observationen, det finns inget sådant samband.

Många missförstånd beror på att det finns olika sätt att existera i världen. Vissa företeelser finns bara för att vi uppfattar dem på det viset, andra finns oberoende av våra uppfattningar. Vi blandar gärna ihop dem, för det är inte så lätt att förstå.

John Searle talar om en skiljelinje som går mellan att finnas i epistemisk (har att göra med kunskap) och ontologisk (har att göra med existens) mening. Epistemisk existens kan vara objektiv eller subjektiv. Att säga att Rembrandt bodde i Amsterdam är epistemiskt sett ett objektivt faktum, medan att säga att Rembrandt är världens största målare är en fråga om bedömning, det är epistemiskt subjektivt.

Även ontologi kan delas upp i objektiva och subjektiva sätt att finnas till. En del existerar oberoende av oss, medan annat bara finns om vårt medvetande är delaktigt. Solen, månen, bergen och atomerna existerar oberoende av att behöva upplevas, medan smärta och klåda bara finns om vi upplever dem. Hur många maskiner som än registrerar smärtan så finns den inte om någon inte medvetet känner den; smärtan är ontologiskt subjektiv.

En liknande uppdelning kan göras mellan vad som finns oberoende av hur vi tänker, som solen, månen och bergen, och sådant som är relativt, eftersom det hänger ihop med våra tankesystem, som pengar, universitet och äktenskap. Dessa är ontologiskt relativa för att de är skapelser av vår civilisation, vårt medvetande. Men att de är relativa medför inte att även våra medvetanden är relativa. Det är de inte, de finns ju. Även påståenden om dessa ontologiskt relativa begrepp kan vara epistemiskt objektiva – universiteten finns ju, till exempel.

– Datorn som jag tittar på nu finns på riktigt, säger John Searle när jag intervjuar honom via Skype. Dess elektroniska kretsar och olika fysiska övergångar finns naturligtvis oberoende av oss. Men Skype-bilden i datorn finns bara i en subjektiv mening. Det kräver en uttolkare och finns alltså bara i en relativ mening.

Det kinesiska rummet handlar om att meningen, semantiken, inte följer ur grammatiken, syntaxen. I dag vill Searle gå ännu längre: inte heller syntaxen, datorprogrammets nollor och ettor, existerar i naturen; de kräver en uttolkare.

– Så vad kan jag säga om superintelligensen? Om du frågar hur mycket verklig intelligens som datorerna besitter som är oberoende av uttolkaren – de må vara intelligenta eller superintelligenta – så är svaret absolut ingenting. NOLL!

John Searle är otålig. I 35 år har han debatterat med AI-forskare runt hörnet i Silicon Valley utan att komma någon vart, tycker han. Det är så mycket fart, glamour och pengar inblandade att ingen bryr sig.

– Om du bara vill att din dator ska fungera, spela schack eller få flygplanet att landa, så spelar det ju ingen roll om du tror att den är intelligent eller inte. Frågan är bara viktig när du ger maskinen ett psykologiskt eller filosofiskt innehåll. Så om vi fruktar att illasinnad superintelligens ska förgöra oss så är det viktigt att apokalypshotet är verkligt. Men utan ett medvetande kan maskinen inte ha egna avsikter, motiv eller mål. Den är ju bara en mycket komplex hög av skrot.

Hur denna skrothög någonsin ska kunna bli medveten kan John Searle inte svara på.

– Vi vet inte. Vi vet bara att evolutionen och naturen har skapat oss, intelligenta varelser som också vet hur det känns att finnas till. Kanske vi någon dag skapar en medveten maskin. Poängen är att det måste vara något helt annat än det vi har i dag. Det räcker inte ens med att bara kopiera eller simulera hjärnan.

Att kopiera, emulera, en hjärna är en ganska utbredd idé för att skapa superintelligens. I stället för att göra den från scratch, tänker man sig att en mänsklig hjärna kan överföras till en dator, ungefär som ett datorprogram som kan flyttas mellan olika maskiner. Fast det tycker John Searle är en märklig tanke.

– Att överföra en hjärna neuron för neuron till en dator är som att överföra en magsäck cell för cell. Hur perfekt kopia du än gör, så får du inte något fungerande kroppsorgan. Du kan ju inte stoppa en pizza i en dator och hoppas att matsmältningen kommer i gång. På samma sätt leder inte en överföring av en hjärna till en dator till att kopian börjar tänka.

John Searle förblir inte oemotsagd; heta debatter kring hans argument har rasat i många år. Filosofen David Chalmers är en av de få medvetandefilosofer som har tagit sig an idéer om singularitet och hjärnöverföring.

– Självklart är frågan om ett medvetande fortfarande ett olöst problem. Men det kommer att lösas, tvärtemot vad John Searle verkar tro. Tänk bara hur osannolikt det verkar att ett mekaniskt system som hjärnan kan ha förståelse och semantik, vara medveten. Ändå är den det.

Rätt konstruerad borde alltså den artificiella hjärnan kunna bli medveten.

– Det stämmer, fast bara till hälften, säger Massimo Pigliucci, professor i filosofi vid City university i New York. Det är sant att vi bara är materia organiserad på rätt sätt. Men inte vilken materia som helst – man måste också titta in i den svarta boxen. Medvetande är en biologisk process som fungerar med en viss uppsättning substanser. Det finns i dag ingen anledning för oss att tro att det skulle fungera med andra substrat. För att inte tala om att hela resonemanget bortser från det enkla faktum att människan inte bara är en hjärna, utan också en kropp.

Det innebär dels att hjärnan är i ständig kontakt med kroppen och dess sinnesupplevelser, dels att vi genom kroppen är förbundna med vår omvärld. Hur man kan påstå att en hjärna utan kropp skulle kunna bli medveten är obegripligt, menar Massimo Pigliucci.

– När AI-forskare beskriver hjärnan som en dator, så förklarar de medvetandet i datortermer: det består av hårdvaran, substrat, och mjukvaran, programmet. För mig är det en variant av den kartesianska dualismen där människan består av två substanser, kropp och själ.

Också den mekanistiska synen på människan kan hänföras till Descartes. Han såg kroppen som en maskin, liksom alla andra djur. Med en tidigare karriär som evolutionsbiolog är Massimo Pigliucci starkt kritisk mot maskinmetaforen. Den fungerar ibland, som när levande celler ska beskrivas på ett förenklat sätt. Men den har också varit skadlig eftersom så mycket måste utelämnas.

– Till skillnad från levande organismer är maskiner konstruerade system; går en del sönder så är maskinen obrukbar. Organismer däremot fungerar ofta nästan lika bra även om de skadas. Det beror på att de är rätt kaotiska, och maskinmetaforen beskriver inte deras verkliga natur.

Massimo Pigliucci påpekar att en av de första som förstod detta var filosofen David Hume. Han debatterade det klassiska urmakarargumentet för Guds existens som den brittiske filosofen William Paley, och även René Descartes före honom, fört fram: att liksom ett ur är skapat av en urmakare så måste även naturen, som är så finjusterad, ha en skapare.

– Hume sade nej, det stämmer inte, naturen är inte som ett ur; den är mycket mer oordnad än så. Så det är en kolossal teknikoptimism att tro att man kan skapa medvetande på konstgjord väg. Och vi vet ju sedan tidigare att tekniken skapar lika många problem som den löser.

Massimo Pigliucci har inte heller mycket till övers för tron på en snabb vidareutveckling av AI.

– Vi har ju redan datorer som överskrider den mänskliga tankeförmågan både i hastighet och datorkraft. Men vi är inte ens i närheten av en intelligent maskin. Det visar att problemet varken ligger i styrkan eller i hastigheten.

Att det har gått fort hittills är ju dessutom ingen garanti för att det ska fortsätta så, anser Pigliucci. Många är dock övertygade om att utvecklingen kommer att gå allt snabbare framåt. Tillväxten fortsätter exponentiellt både när det gäller hårdvaran, där processorer blir allt snabbare på allt kortare tid, och mjukvaran, med allt bättre algoritmer. Så har till exempel Eliezer Yudkowsky vid Machine intelligence research institute beskrivit den kommande utvecklingen:

”Beräkningshastigheten fördubblas för varje tvåårsperiod. Två år efter att artificiell intelligens når den mänskliga fördubblas hastigheten. Ett år senare ökar den igen. Sex månader – tre månader – 1,5 månader – singularitet.”

Och som sagt, den utvecklingen är inte bara av godo. En del AI-forskare, som till exempel en av de mest namnkunniga, Stuart Russel vid Berkeley university, uppmanar till försiktighet och jämför med utvecklingen av atombomben: Vi måste lösa kontrollproblemet. Anden är redan ute ur flaskan, och det är oundvikligt att det kommer att bli ett allt högre tryck från kommersiella och militära intressen.

Fredrik Heintz tror att utvecklingen kommer att fortsätta.

– Fast apokalypsen är ju bara en möjlig utgång. Tekniken finns inte oberoende av oss, så det blir intressant att följa den och se hur vi människor kan använda tekniken för att hänga med. Jag tror att datorerna kommer att existera i symbios med oss. Artificiell intelligens kan hjälpa oss att bli mer effektiva, kunna göra mer avancerade saker och bidra till högre välstånd i hela samhället.

Enkät

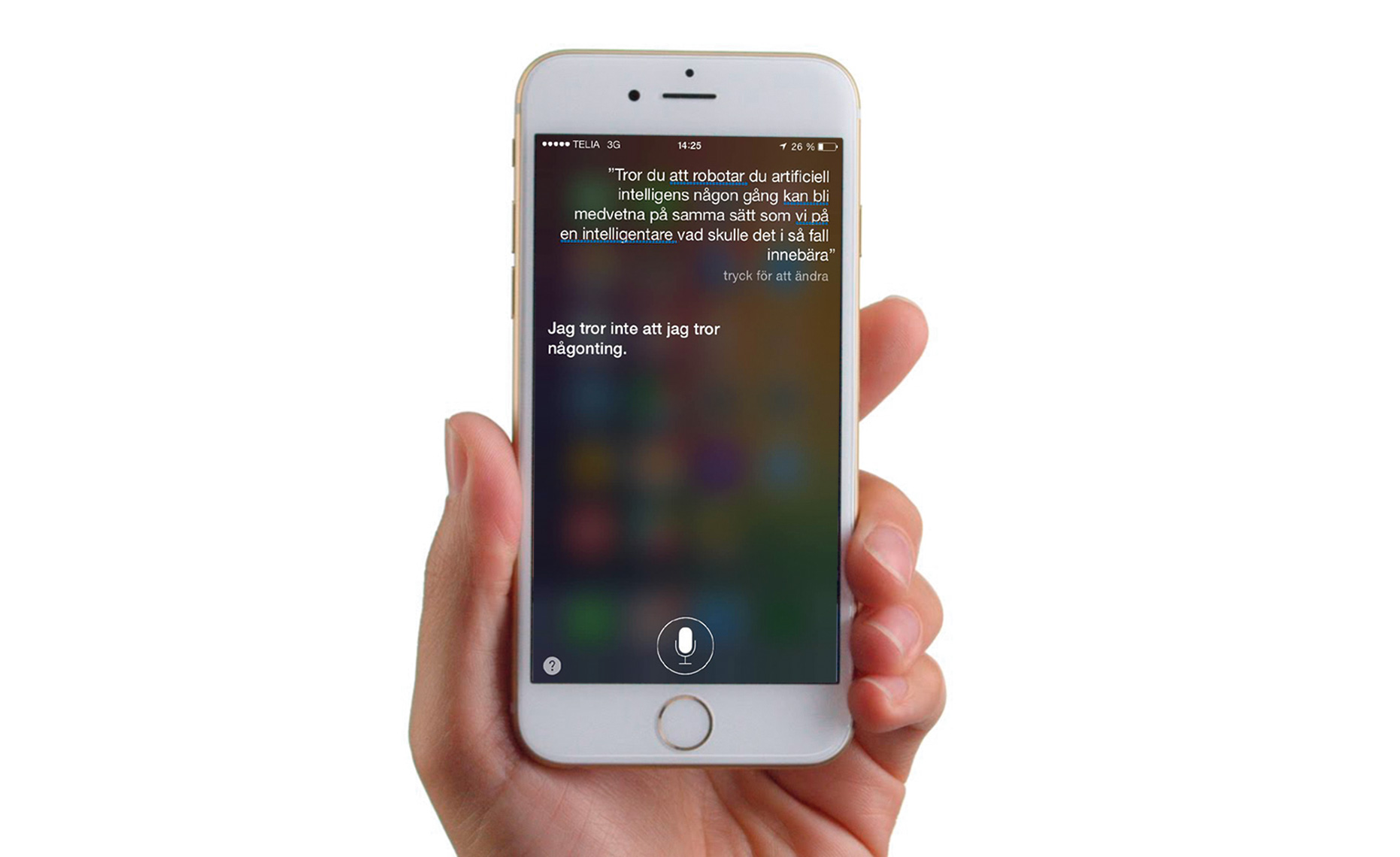

Tror du att robotar med artificiell intelligens någon gång kan bli medvetna på samma sätt som vi – och ännu intelligentare? Vad skulle det i så fall innebära?

Bild: Annika af Klercker

Pablo Luna, 23 år: Ja det tror jag. Men jag tror inte att nivån av känslor kan bli densamma. Jag tror också att vår syn på vad som är intelligens kommer att förändras på ett eller annat sätt. Och i slutänden tror jag att robotar faktiskt kommer att ta över. Till en början inom exempelvis industrin – och senare inom andra delar av samhället.

Bild: Annika af Klercker

Peter Andersson, 55 år: Jag är övertygad med tanke på hur utvecklingen har sett ut den senaste tiden. Jag tror så klart inte att det kommer att ske inom 10–20 år, men troligen om 200 år. Jag tror inte att vi kommer att ha samma behov av arbete i framtiden. Människan kommer att få en annan typ av roll i samhället och arbetet kommer att tas över av den teknik som kommer att finnas då, om det nu är datorer eller robotar.

Bild: Annika af Klercker

Anne-Line Björkén, 64 år: Nej, för jag tror inte att intelligens bara kan mätas med IQ. Jag har till exempel svårt att tänka mig att vi kan ersätta lärare eller vårdpersonal med robotar. Dessutom tror jag att det skulle bli ett dåligt samhälle om färre människor arbetar och maskiner tar över.

Bild: Annika af Klercker

Isabella Lundgren, 27 år: Nej, jag har svårt att föreställa mig att man kommer att kunna simulera och beräkna något som liknar mänsklig intelligens. Hur kan man exempelvis beräkna empati? Men de kan säkert komma att uppnå enormt hög intelligens i rationella frågor.

Jag hoppas att det i så fall innebär att det används till något positivt. Men tyvärr har vi ju lärt av historien att många uppfinningar som varit ämnade för något gott, i stället har använts till fruktansvärda saker.

Bild: Annika af Klercker

Helena Gutarra, 37 år: Absolut. Det känns som att man redan nu ser en utveckling där vi själva ska göra så lite som möjligt och röra oss så lite som möjligt. Se bara på fabriker och industrier. Jag tror inte att den utvecklingen är positiv. Det kommer att leda till ett kallare samhälle om det saknas känslor i de beslut som fattas.

Siri, 4 år: Jag tror inte att jag tror någonting. (Siri är en hjälpfunktion i Apples mobiltelefon Iphone som använder AI-teknik för att svara på användarens frågor)

Av Annika af Klercker