Bild: Fabio Pignata

”Piloterna måste kunna flyga med rumpan”

Det finns en fråga som du absolut inte vill att piloterna i cockpit ska behöva ställa: ”Vad hände nu?” Men enligt Patrik Stensson, doktorand på Försvarshögskolan, är det inte ovanligt att den finns med i ljudupptagningarna i den svarta lådan efter ett haveri.

– Det är svårt för människor att sätta sig in i hur den avancerade automationen i ett flygplan fungerar. Kommentaren kommer när tekniken uppför sig på ett sätt som piloterna inte har förutsett, säger han.

Air France-piloterna på flight 447 den 9 juni 2009 verkar ha hamnat i just en sådan situation.

Flygplanet, en Airbus A330, lyfte från Rio de Janerio med Paris som destination. Men på väg över Atlanten händer något, och det störtar. De 228 personer som finns med ombord omkommer i olyckan.

Exakt vad som orsakade olyckan är inte färdigutrett. Men den franska haverikommissionen har hittills publicerat tre delrapporter och bilden börjar klarna.

Kjell Ohlsson, professor i människa–maskininteraktion vid Linköpings universitet, har följt utredningen.

– Som alltid är det flera faktorer som har samverkat. Allt verkar ha börjat med igenfrusna pitot-rör, säger han.

Pitotrören används för att bestämma planets hastighet, genom att mäta skillnaden i lufttryck hos den omgivande luften och det extra lufttryck som planets framåtriktade rörelse orsakar.

Men när pitotrören fryser igen, vilket uppvärmningsanordningar ska förhindra, stämmer inte längre uppgifterna om planets hastighet.

Två timmar och tio minuter efter att planet har lyft från Rio börjar hastighetsangivelserna växla kraftigt, vilket får autopiloten att koppla ifrån. Av någon anledning verkar piloterna ignorera varningen om att planet är på väg att överstegra, och de lyfter planets nos. Resultatet är att planet tappar lyftkraften.

Under de minuter som passerar mellan den första varningen om överstegring och att planet slår i vattnet varierar hastighetsangivelserna kraftigt. Dessutom ökar anfallsvinkeln, planets nos i förhållande till vindriktningen, till över 35 grader, långt mer än vad en Airbus A330 klarar under de aktuella förutsättningarna.

Men även om brister i tekniken var den första svaga länken är de enligt honom inte hela förklaringen till den tragiska olyckan.

– Piloterna lyfte planets nos i stället för att sänka den för att återfå lyftkraften genom ökad hastighet. De kallade inte heller omedelbart på kaptenen som hade lämnat cockpit för att vila, vilket är ett organisatoriskt problem. Allt detta tyder på bristande träning och medvetenhet hos piloterna om vad som kan hända på hög höjd, vilka sensorer som kan fallera och hur man kan reda ut problemen, säger Kjell Ohlsson.

Efter årsskiftet ska den slutgiltiga olycksrapporten vara färdig. Under hösten granskar haverikommissionen bland annat hur piloternas agerande och utformningen av interaktionen människa–system påverkade händelseförloppet.

Patrik Stensson på Försvarshögskolan forskar om hur teknik bäst kan utnyttjas i oförutsägbara situationer. Han har inte studerat olyckan med Air France-planet i detalj, men gör en generell reflektion:

– Det finns en övertro på våra matematiska analyser av verkligheten och de simulerade försök som bekräftar att automatiserad teknik fungerar. Vi inbillar oss att verkligheten går att reducera till en idealvärld som kan beskrivas fullständigt med deterministiska modeller. Hade det varit så, då hade automation alltid fungerat perfekt, säger han.

Det tycks alltså vara så att man bara simulerar hur tekniken fungerar under normala förutsättningar, men glömmer bort extremerna, det mer oförutsägbara.

– Jag kallar det för the vicious circle culture, där vi utvecklar automatiserad teknik utifrån analytiska modeller av verkligheten och verifierar dess funktion i simulatorer som också är analytiska modeller av verkligheten. Det blir en självuppfyllande profetia där automationen självklart fungerar tillfredsställande.

Men när tekniken flyttar från utvecklingsavdelningen ut i verkligheten finns risken att den till slut möter extremfallen som inte har simulerats. Man talar om att system kan ha inbyggda, latenta fel. De märks inte i normal drift, men framträder när ett antal faktorer samspelar på ett olyckligt sätt.

Lena Mårtensson är professor i industriell ergonomi vid Kungliga tekniska högskolan. Hon har bland annat utrett Gottröra-haveriet ur människa–maskinperspektiv.

– Det behöver ju inte vara fel som begås av piloten som orsakar en olycka, även om haverier ofta skylls på den mänskliga faktorn. Nu finns det krav på att alla flygbolag ska ha ett safety management system för att säkerhetstänkandet ska genomsyra alla nivåer i flygbolagen. Tidigare tittade man enbart på tekniken, men nu granskar man också organisationen, säger hon.

Patrik Stensson skulle vilja se ännu tydligare steg åt det hållet. I säkerhetsforskning används bland annat termerna kalkylativ och generativ säkerhetskultur.

– Stora delar av samhället, inklusive flygbranschen, har ett kalkylativt tänkesätt, där man tror att man har metoder och lösningar för alla tänkbara problem. Den generativa säkerhetskulturen återfinns oftast hos katastroforganisationer, exempelvis räddningstjänst och polis, där man tar för givet att saker går åt pipan förr eller senare, säger Patrik Stensson.

Han vill att man ska applicera det generativa tänkesättet på både utveckling och teknikanvändning, att man faktiskt inte känner till allt som kan hända och att man därför måste förbereda sig på att hantera det oförutsägbara.

– Ett problem är att vi människor är ganska oförutsägbara, att vi gör oväntade saker i bland. Det är en av anledningarna till att ”den mänskliga faktorn” blir syndabock, säger Patrik Stensson.

– En av de allvarligaste bristerna är att systemen inte tillåter att användaren gör något oförutsett. Det är ju genom vår naturliga variation som vi testar gränserna, som vi lär oss att upptäcka och undvika faror.

En person som kan cykla har skaffat sig den färdigheten på just det sättet. Efter några vurpor har han eller hon den hårda vägen lärt sig hur hög fart som krävs för att behålla balansen, hur kraftigt det går att svänga, hur ett halt underlag känns.

Och precis som en cyklist är en pilot i behov av grundkunskaper att luta sig mot. Vid Gottröra-olyckan var det just erfarenhet som räddade människorna ombord på SAS-planet.

– När båda motorerna slutade fungera var det det grundläggande flygkunnandet som hjälpte dem. I intervjuer jag gjort med piloterna säger de att det var back to basic flying som gällde, de visste att det gick att glidflyga också stora flygplan från den höjd där de befann sig och hur de skulle hålla planet rätt på vingarna, säger Lena Mårtensson.

För flygbranschen är det här en svår balansgång. Å ena sidan, ett behov av automation för att dagens moderna flygplan över huvud taget ska kunna flyga. Å andra sidan, ett starkt önskemål om piloter som bemästrar tekniken så länge den fungerar, och som kan ta över när den fallerar.

All automation, alla datorer, har skapat ett artificiellt filter mellan piloterna och den faktiska fysik som får planet att flyga – tekniken har blivit abstrakt.

– Det finns ett gammalt klassiskt pilotuttryck som säger att man ska lära sig att ”flyga med rumpan”. Den känslan får man efter att ha stötts och blötts tillsammans med tekniken, och lärt känna den. Som en cyklist. Men det går inte att lära känna ett dolt, datoriserat system eftersom det inte finns några naturliga kanaler att lära känna, säger Patrik Stensson.

Ytterligare en jämförelse får illustrera tankegången: I en traditionell förbränningsmotor finns flera kanaler för återkoppling inbyggda. Motorn ger ifrån sig ljud, värme, vibrationer, lukt. En dator ger däremot ifrån sig väldigt få, om ens några, naturliga signaler. Dessutom finns stora skillnader i dynamiken. Att öka varvtalet i en motor från noll till max tar lite tid och följer en välkänd kurva, medan en dator kan växla mellan viloläge och toppfart på en klockcykel. Konsekvensen är att ett datoriserat system kräver en konstgjord återkoppling, där konstruktörerna i samarbete med användarna har bestämt vilka signaler som behövs för att kunna övervaka och förstå tekniken.

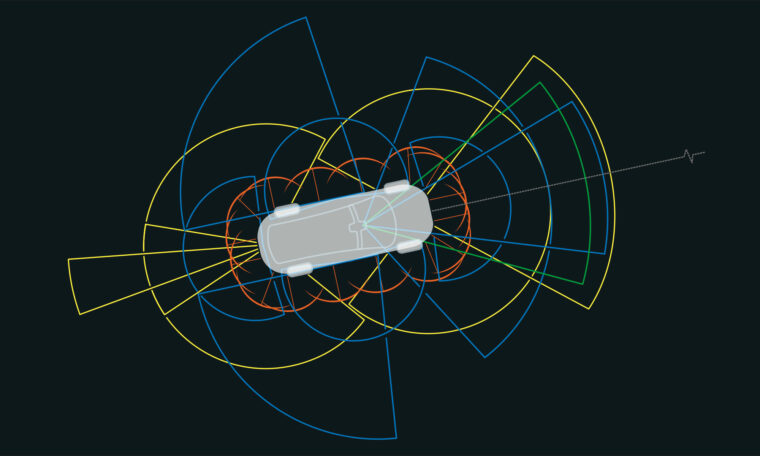

I ett flygplan kompliceras situationen ytterligare av alla delsystem som ska kommunicera med varandra och med piloten. I cockpit blir datorskärmarna allt fler, där information från flera delsystem bakas samman till en enda presentationsyta.

– I slutändan sitter piloterna med ett gränssnitt mot ett system som styr många andra. Och så glömmer man bort det väsentliga, att piloten behöver veta vilka effekter de bortre systemen åstadkommer i verkligheten, säger Patrik Stensson.

Digital teknik har dessutom en tendens att fungera felfritt till dess att den inte fungerar alls, och då vet man egentligen inte vad det var som gick fel. Patrik Stensson igen:

– Om temperaturmätaren i din bil börjar pendla fram och tillbaka hej vilt innan den lägger sig på noll, då drar du nog slutsatsen att det är ett mätarfel och inte motorn som har tvärkallnat. Du har fått lite feedback om att det var just instrumentet som lade av och inte själva funktionen som instrumenten övervakar. Problemet är att när man digitaliserar tekniken blir det här väldigt svårt att avgöra. Man vet inte om det är strömmen in till systemet som har lagt av, om det är en bugg i programmet eller om det faktiskt är ett driftstopp.

Så vad kan man göra för att designa relevanta återkopplingsloopar för digitala system? Ett sätt är enligt Kjell Ohlsson att man i högre utsträckning än i dag använder sig av en så kallad iterativ utvecklingsprocess.

– Det innebär bland annat att man på kort tid tar fram många prototyper som man testar på piloter, för att välja ut de spår som verkar mest lovande. Sedan gör man förändringar och testar igen, i flera varv, säger han.

I allt högre utsträckning strävar man också efter transparens i systemen, att designa dem på ett sätt så att piloterna förstår varför tekniken agerar på ett visst sätt.

– Det är klart att det är knepigt att åskådliggöra, men det finns olika sätt att visualisera hur automationen framskrider och varför, säger Kjell Ohlsson.

Han exemplifierar bland annat med utredningarna av haverierna med Jas 39 Gripen. Gripen är ett så kallat instabilt plan som kräver avancerad automation för att över huvud taget kunna flyga. Problemet var att det ursprungligen saknades återkoppling i styrspaken om hur styrsystemen faktiskt arbetade. Efter FOA:s studier i en fullskalesimulator kunde bristen upptäckas och åtgärdas.

Ett annat problem i kritiska situationer är inte att det saknas information, utan att piloterna i stället blir helt överhopade av varningar när alla delsystem pockar på uppmärksamhet samtidigt. I de intervjuer som Lena Mårtensson gjorde med piloterna från Gottröra-olyckan berättar de om hur cockpit fylldes av syntetiskt tal och blinkande lampor.

– Men det finns sätt att lösa det också. I Saab 2000-plan kopplas till exempel den syntetiska rösten bort under start och landning, just för att inte stressa piloterna, säger hon och fortsätter:

– Ett modernt flygplan har så många delsystem, och i en kritisk situation vill alla nå fram till piloterna med sina varningar. En av de stora utmaningarna är att filtrera i flödet och bara presentera det absolut viktigaste för piloterna.

Kjell Ohlsson tror att en väg framåt är mer så kallad fuzzy logic, en logik där saker kan vara delvis sanna eller falska till skillnad från traditionell logik där värden bara är antingen sanna eller falska. I praktiken innebär det att datorerna får ett sätt att resonera sig fram till bästa beslut.

Som passagerare på ett linjeflygplan vill vi inte att piloterna ska behöva undra vad som hände. Vi förväntar oss att de har full kontroll på situationen. Men i takt med att automationen drivs längre, desto fler utvecklingsingenjörer och programmerare finns det någon annanstans, som någon annan gång för länge sedan fattade de beslut som planet agerar utifrån här och nu. Vad är rätt balans mellan automation och mänsklig kontroll? Kjell Ohlsson, Lena Mårtensson och Patrik Stensson är överens om att frågan inte har något enkelt svar och att jakten på den fortsätter. Men piloternas kompetens är också i framtiden en nyckelfaktor:

– Oavsett hur bra teknik du utvecklar, oavsett hur avancerad automation du fyller planen med så kommer det att inträffa oförutsedda händelser där det krävs erfarenhet och skicklighet för att lösa problem. Och då har vi paradoxen: ju mer automation som används, desto mindre erfarenhet och skicklighet kommer piloterna att få, säger Patrik Stensson.

Analys

Kjell Ohlsson, som är professor i människa–maskininteraktion vid Linköpings universitet, har följt haveriutredningen av Air France flight 447. Han konstaterar att det som vanligt var en kombination av flera faktorer som orsakade olyckan, bland annat:

1. Tekniska brister. Pitot-rören som används för att mäta hastighet och höjd är en ålderdomlig lösning. De borde enligt Kjell Ohlsson enkelt kunna kompletteras med gps-information. Det saknas också indikationer för planets anfallsvinkel. En för hög anfallsvinkel innebär att planet tappar lyftkraft.

2. Brister i organisationen. Piloterna hade inte fått tillräcklig träning på hur problem av den uppkomna typen ska lösas på hög höjd. Inte heller hade de fått tillräcklig utbildning i crew resources management, vilket Kjell Ohlsson tror kan vara förklaringen till att det dröjde innan den vilande kaptenen kallades tillbaka till cockpit.

3. Personlig okunnighet. Hos co-piloterna som satt vid spakarna saknades bland annat kunskap om hur varning om överstegring och felindikationer i hastighetsangivelse ska hanteras.

”Vi kommer att krascha. Det kan inte vara sant!”

Air France flight 447 skulle flyga från Rio de Janeiro till Paris den 1 juni 2009. Men flygplanet kraschade i Atlanten.

Efter nära två års sökande hittades de båda färdskrivarna; de svarta lådorna. De låg på 3 900 meters djup, nästan rakt under nedslagsplatsen.

Dagens färdskrivare har små spårsändare som skickar ut signaler under vatten så att lådorna lättare kan hittas. Signalerna från Air France-planet var dock svaga och upphörde efter ungefär en månad, då batterierna tog slut.

Det krävdes tre stycken självgående undervattensfarkoster av typen Remus 6 000 (se F&F 4/2006) för att lokalisera vraket.

Därefter skickades mer robusta robotar ner, som kunde plocka upp vrakdelar och de två färdskrivarna. De senare innehöll data från flygplanets instrument och en inspelning från piloternas samtal före kraschen.

Inspelningen avslöjar hur piloterna in i det sista kämpade för att förstå vad som egentligen höll på att hända:

Marc Dubois (kapten): Tio graders stigning.

David Robert (andrepilot): Tillbaka upp! … Gå upp! … Gå upp! … Gå upp!

Pierre-Cedric Bonin (tredjepilot): Men jag har gått ner på maxnivån ett tag nu.

Dubois: Nej, nej, nej! … Gå inte upp! … Nej, nej!

Bonin: Gå ner, i stället!

Robert: Fan också! Vi kommer att krascha. Det kan inte vara sant!

Bonin: Men, vad händer?!

Inspelningen upphör.

*Källa: Crash RIO-PARIS, Jean-Pierre Otelli (Altipress)*