”Vi måste prata om AI utan att förfäras eller förföras”

En ny generation självlärande maskiner tar över allt fler uppgifter som tidigare varit människans exklusiva domän. Den tekniska utvecklingen kräver ett mer kulturvetenskapligt, tolkande och kritiskt samtal om AI, skriver filosofen Hans Ruin.

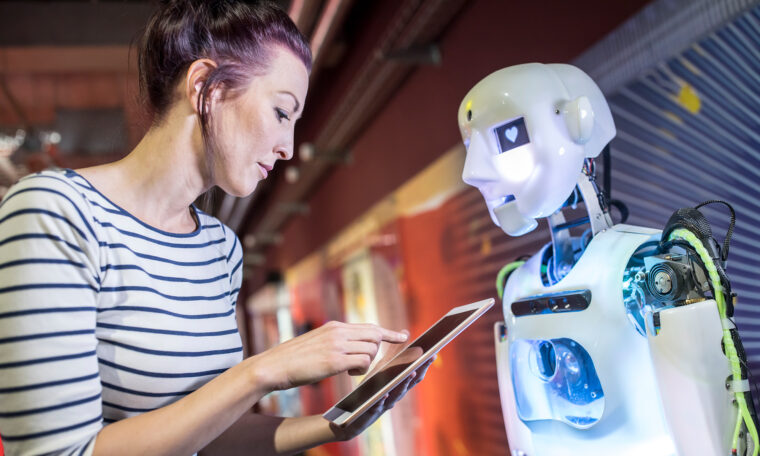

Tekniska framsteg utvidgar människans handlingsförmåga, men följs ofta också av en kulturell oro.

Bild: Getty images

Luigi Galvanis experiment med grodor från 1780-talet blev ett viktigt steg på vägen mot förståelsen av elektricitet och batteriteknik. Själv trodde han på en särskild ”animalisk elektricitet”, vilket bland annat inspirerade Mary Shelley när hon lät uppfinnaren Frankenstein väcka ett lapptäcke av döda kroppsdelar till liv. Det skulle ta ytterligare hundra år innan elektriciteten fick sitt praktiska genombrott i form av alla de tekniska applikationer som under nittonhundratalet förvandlat människans livsvillkor genom att ta över allt större delar av hennes fysiska arbete.

Till denna elektriska förvandling av livet hör också den digitala teknik som nu snabbt tar över även allt fler kognitiva sysslor. Inledningsvis rörde det sig om beräkningar och styrsystem. Men med den nya generationen självlärande maskiner, vars kapacitet växer genom användning, handlar det även om att diagnosticera, lokalisera, identifiera, investera, döma, översätta och även skriva.

Teknik alstrar vidskepelse

Varje tekniskt framsteg utvidgar människans handlingsförmåga. Men därmed följer ofta också en kulturell oro. Det får henne att pendla mellan storhetsvansinne – tanken att allt kan kontrolleras med teknik – och underkastelse – att tekniken i själva verket är på väg att helt ta över hennes liv. Liksom vid upptäckten av elektriciteten har även denna utvidgning alstrat vidskepliga föreställningar, som tron att maskinerna har medvetande, att de i någon mening lever och rentav står i begrepp att ta över världen.

Till sådana spektakulära idéer finns det anledning att förhålla sig avvaktande. Samtidigt kräver de förvandlingar vi står inför som en följd av AI fördjupade analyser, inte minst när det gäller arbetsliv och samhällets organisering. Det behövs forskningsmiljöer som kan fungera som nav i ett offentligt samtal om vad som egentligen sker och hur det bör hanteras politiskt och juridiskt.

En tongivande miljö är Future of Humanity Institute i Oxford som drivs av den svenske filosofen Nick Bostrom. De har specialiserat sig på storskaliga alarmistiska scenarier om möjliga hot som kan följa med uppkomsten av vad de kallar ”superintelligens”: Å ena sidan rymmer det möjligheten att lösa nästan alla stora problem, å andra sidan kan det slunga mänskligheten ner i ”extrem ojämlikhet, global tyranni, instabilitet som utlöser globalt kärnvapenkrig, katastrofalt farliga teknologier etc”.

Nya lagar är på väg

Det är alltid klokt att vara öppen för det värsta i livet. Men risken med detta slags apokalyptiska visioner och de etiska regelverk som följer – så kallad ”AI governance” – är att de snarare blir skrivbordsfantasier utan verklighetsförankring. Det är också ett problem att de är nära lierade med de stora teknikföretag som utvecklar applikationerna.

Samtidigt pågår ett praktiskt arbete bland lagstiftare att ta fram regelverk för AI. Det gäller särskilt inom EU-parlamentet, som är ledande i världen på detta område och som förväntas lägga fram ett nytt lagpaket senare i år. Det handlar då i första hand om att stävja potentiella inskränkningar av rättigheter i frågor om övervakning, identifikation och styrning.

Parallellt med dessa viktiga initiativ behöver vi dock fortsätta att tänka i bredare banor kring de förändringar som sker. Det behövs ett fördjupat samarbete mellan ingenjörer och historiker, samhällsvetare, ekonomer, arbetslivsforskare och filosofer, inte i första hand för att producera etiska råd för tillämpningen av en tänkt teknik, utan för att belysa, förklara och tolka vad som nu sker. Den etiska oro som en ny teknik framkallar hanteras bäst av kunskap om hur den fungerar, varför den utvecklas, av vem och i vilket syfte. I korthet: genom att den placeras inom ett mänskligt ekonomiskt, politiskt och historiskt sammanhang.

Samspelet med maskinerna förvandlar oss

Ett löftesrikt steg i den riktningen är det som på senare år framträtt som ”kritiska AI-studier”. En första antologi utkom år 2020, The Cultural Life of Machine Learning. An Incursion into Critical AI Studies, redigerad av de brittiska och kanadensiska sociologerna och datalogerna Jonathan Roberge och Michael Castelle. Hellre än att bara förfäras eller förföras av dessa innovationer, och hellre än att barrikadera sig bakom en krympande föreställning om det mänskliga intellektets unika kvaliteter, försöker de placera den nya nivån av interaktion mellan människa och maskin i en bredare historisk och samhällelig kontext.

Delvis måste det handla om makt och motiv, om vem som styr över forskning och tillämpning, och om vikten av en demokratisk kontroll över teknikens tillämpningar. Men interaktionen mellan människa och maskin handlar inte bara om kontroll eller kontrollförlust. Det handlar om hur vi som användare i vår fortsatta interaktion med dessa nya maskiner förvandlar oss själva och våra samhällen. Maskinen är inte något främmande väsen med en egen vilja, men genom att införliva den i våra liv, förändras oundvikligen också vi själva. Vem blir människan när hon även börjar förlägga sitt omdöme på maskinell entreprenad? Vad händer med ansvaret i ett sådant samhälle? Det är en fråga som vi kommer att ställas inför allt oftare under de år som kommer.

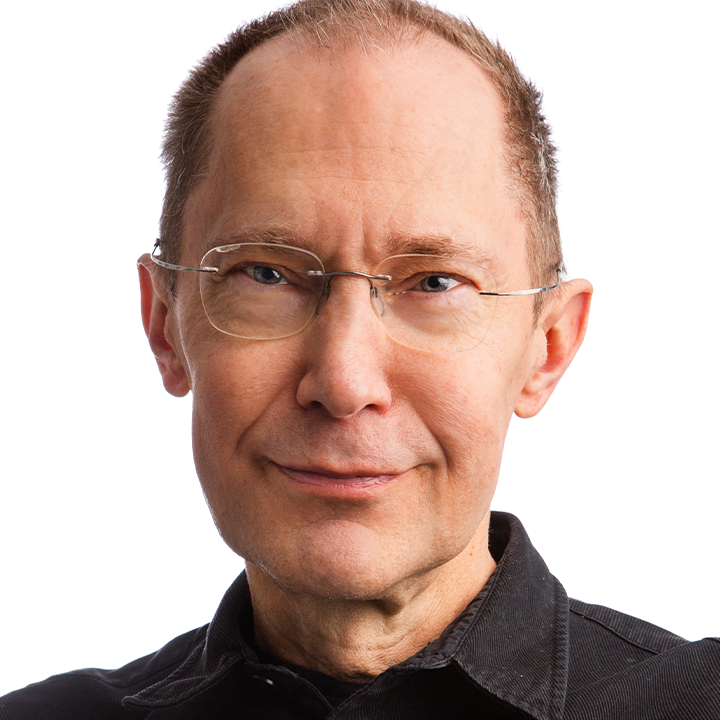

Hans Ruin

- Professor och grundare av filosofiämnet vid Södertörns högskola

- Ledde det stora mångdisciplinära forskningsprojektet Tid, minne och representation (RJ 2010–2016)

- Medgrundare och tidigare president för Nordic Society for Phenomenology

- Medutgivare av Nietzsches Samlade skrifter på svenska

- Har nyligen utgivit skriften Om den artificiella intelligensens gränser (RJ/Makadam, 2022)

- Talar på En kväll om livet efter digitaliseringen 25 januari 2023.

Kunskap baserad på vetenskap

Prenumerera på Forskning & Framsteg!

Inlogg på fof.se • Tidning • Arkiv med tidigare nummer