Lagstiftningen och AI i otakt – men det kan vara bra

EU får världens första omfattande AI-reglering, EU AI Act. Men att reglera teknik under snabb utveckling är en stor utmaning.

EU får en ny AI-lagstiftning.

Bild: Getty images

Uppdatering: Det här är en artikel från 2023. EU:s AI-förordning röstades igenom 13/3–2024.

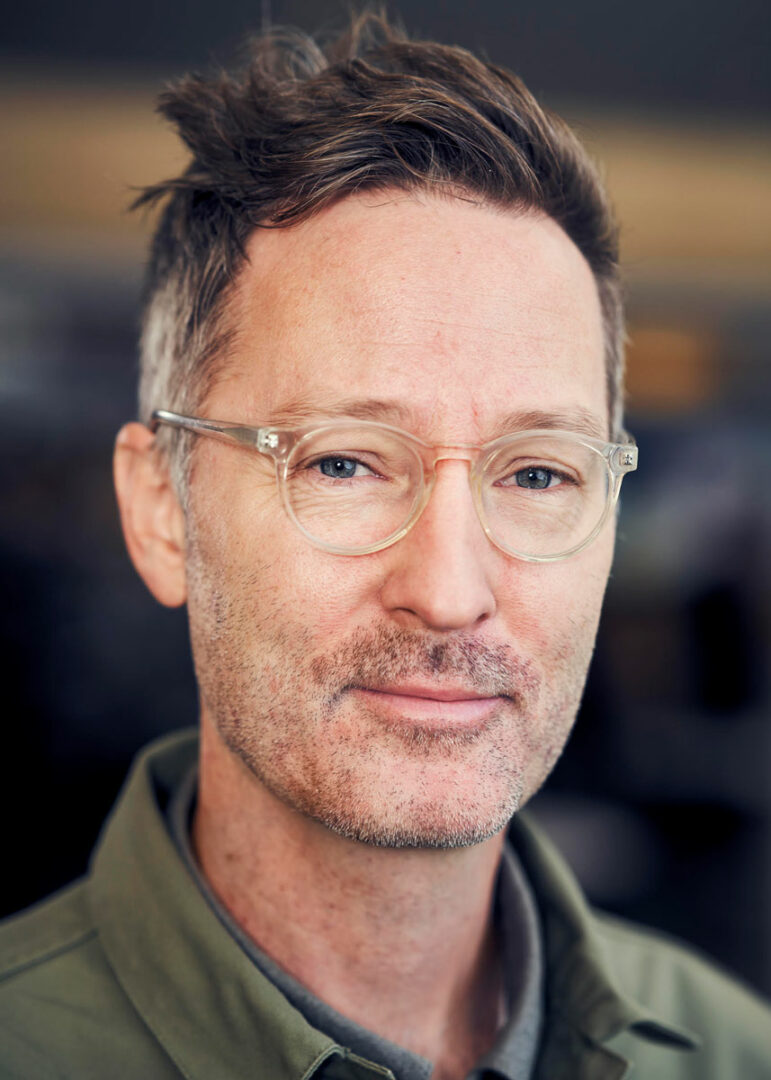

Arbetet med AI-lagstiftningen inom EU startades för drygt två år sedan. Nu pågår slutförhandlingar mellan EU-ländernas ministrar och EU-kommissionen om hur den slutliga förordningen ska se ut. Att reglera teknik under snabb utveckling är en stor utmaning. Det säger Stefan Larsson, docent i teknik och social förändring vid Lunds universitet.

– Man kallar det ibland för ett taktproblem. Det vill säga, en idé om att teknikinnovation går snabbt samtidigt som lagstiftning går långsamt. Men, samtidigt, det tar tid att förutse konsekvenser av en ny teknik på ett bra sätt så det finns en poäng med att inte ändra lagar för snabbt.

Bild: Johan Persson

Flexibilitet i lagstiftningen

Taktproblemet är extra uttalat när det gäller AI, anser han. Utvecklingen går oerhört snabbt samtidigt som AI påverkar stora delar av samhället. När det första förslaget till AI-förordning presenterades av EU-kommissionen i april 2021 hade till exempel Chat GPT ännu inte lanserats. Själva definitionen av AI har också förändrats under lagförslaget väg genom de olika EU-instanserna.

– Ett sätt att möta detta är att lägga in element av flexibilitet i lagstiftningen, säger Stefan Larsson. Definitionen av AI kanske inte är fixerad utan kan röra på sig. Vissa frågor kan också lösas genom särskilda genomförandeakter eller via standardiseringsorganen som tar fram specifika standarder för hur kraven kan uppfyllas.

Riskbedömer tillämpningar

EU:s AI-förordning bygger på en riskbedömning av olika tillämpningar. De allra mest riskfyllda användningsområdena klassas som oacceptabla och förbjuds. Hit hör till exempel social övervakning av den typ som förekommer i Kina där medborgare poängsätts, och så kallad biometrisk övervakning där personer identifieras i realtid med hjälp av egenskaper som ansiktsigenkänning.

Snäppet under är områden som EU klassar som ”hög risk” för samhället och enskilda individer. Hit hör AI som används i skolan, av domstolar, inom kritisk infrastruktur, för övervakning, vid anställningar och migration. Användning inom dessa områden är tillåten bara om den följer de regler som EU ställer upp och gällande bland annat krav på testning, säkerhet och teknisk dokumentation. Människor ska förstå att de interagerar med ett AI-system om det inte är uppenbart.

En het fråga nu är hur stora generella AI-modeller, så kallad generativ AI eller foundation models, ska regleras. Det är den typen av modeller som ligger till grund för tjänster som Chat GPT och som inte fanns med i det ursprungliga förslaget.

– Det är ett allmänt verktyg, man kan kalla det för flerändamåls-AI, som kan göra många olika saker och som är svårt att sätta in i den här riskhierarkin. Vissa tillämpningar har väldigt låg risk, men när de används bedrägligt, som för att manipulera eller påverka val, kan risken vara väldigt hög och det är något lagstiftarna brottas med i riskklassificeringen, säger Stefan Larsson.

Krav på transparens

I somras föreslog EU-parlamentet att även regler kring de stora generella datormodellerna ska behandlas i AI-förordningen. Framför allt handlar det om krav på transparens. Företagen bakom modellerna ska enligt förslaget bland annat dokumentera vilken data som modellerna tränas på och om data innehåller upphovsrättsskyddat material. Det ska även framgå när till exempel bilder är AI-genererade. Företagen ska också tala om hur mycket energi som gått åt för att ta fram modellen.

Stefan Larsson betonar att AI-tillämpningar givetvis kan täckas av redan befintlig reglering, som diskrimineringslagstiftning och dataskydd.

– Där blir frågan hur den lagstiftningen ska tolkas i ljuset av ny AI-funktionalitet som utvecklas.

En utredning om risker för diskriminering pågår hos diskrimineringsombudsmannen och ska presenteras i november. Andra områden som berörs av AI är till exempel upphovsrätt, dataskydd, konkurrensskydd och konsumentskydd.

Läs mer: AI het fråga inom upphovsrätt