Techmiljardärernas luftslott, eller vägen till ett framtida lyckorike?

Bild: Getty images

Därför sätter longtermisterna framtiden före nuet

Vad är vi beredda att offra för människor som lever om en miljon år? Inom longtermismen värderas det vi gör i dag utifrån framtida nytta. Men kritiker ser etiska och politiska risker på vägen mot filosofins vällovliga mål.

Om du ställs inför möjligheten att rädda ett barns liv måste du göra det, skulle många säga. Men om du måste välja mellan att rädda ett barn i dag eller att rädda en miljon barn om tusen år, vad skulle du göra då?

Den sortens frågor ställs på sin spets inom longtermismen, en filosofisk strömning med ambitioner att skapa en god framtid i det riktigt långa loppet – därav namnet – men som skapat debatt långt utanför filosofernas kretsar och ända till Aftonbladets kultursida. Något som gör longtermismen till mer än ett ämne för akademiska seminarier är att den utvecklats i miljöer som stöds ekonomiskt av techmiljardärer som Elon Musk och Skype-grundaren Jaan Tallin.

Longtermismen har vuxit fram ur effektiv altruism-rörelsen, som utvärderar filantropiska insatser för att optimera möjligheterna för individer att göra världen bättre. Men samtidigt som longtermismen bottnar i ambitionen att hjälpa människor tycks den kunna leda till kontroversiella slutsatser: Kan det vara rätt att offra ett barn som behöver hjälp här och nu för att i stället skapa förutsättningar för att många fler barn ska få leva långt in i framtiden?

Prioriterar framtiden

Ordet longtermism myntades omkring 2017 av två nyckelpersoner inom effektiv altruism, filosoferna William MacAskill och Toby Ord vid University of Oxford. William MacAskill har definierat longtermism som synsättet att en av de viktigaste moraliska prioriteringarna i vår tid är att påverka framtiden i positiv riktning. Man kan säga att longtermismen ger framtiden mycket högre prioritet än vad som annars är brukligt. William MacAskill har också tillsammans med filosofen Hilary Greaves formulerat en starkare variant som kallas strong longtermism och som säger att den långsiktiga framtiden rentav är den allra viktigaste frågan.

Synsättet bygger på resonemang om framtidens enorma värde och potential.

Bild: David Fisher

– Om man bara antar någonting ganska modest, att vi människor överlever ungefär som vilken däggdjursart som helst i ungefär en miljon år – även om du inte antar en jättepopulation så betyder det att det finns många fler framtida liv än det har funnits i det förflutna, eller nu, säger Anders Sandberg, forskare vid Future of humanity institute inom samma fakultet på Oxfords universitet där William MacAskill och Toby Ord är verksamma.

Framtidens liv är lika verkliga som våra, resonerar filosoferna, även om vi inte kan se dem eller känna till något om dem. Då blir det en moralisk skyldighet att se till att dessa liv inte hotas.

Var och en förstår sig på att bry sig om sina närmaste, men kretsen som vi bryr oss om kan utökas. Den australiensiske filosofen Peter Singer har pekat på hur den moraliska cirkeln genom tiderna har vidgats till att omfatta även människor långt borta som vi aldrig har mött. Människors liv på andra sidan jorden är värda lika mycket som liv här. Kanske bör den moraliska cirkeln också omfatta djuren och miljön, menar Peter Singer. Nästa steg blir att inkludera också människor som inte lever ännu.

Räknar på existensiell risk

Begreppet existentiell risk introducerades av den svenskfödde filosofen Nick Bostrom i början av 2000-talet. Det syftar på sådana risker som skulle kunna utplåna mänskligheten helt eller göra framtida människors liv mycket dåligt. Nick Bostrom arbetar även han vid universitetet i Oxford, och han är grundaren av Future of humanity institute. Han blev känd för allmänheten med sin bok Superintelligens 2014 (på svenska 2017) och 2019 sommarpratade han i Sveriges Radio P1.

Bild: TT-bild

Nick Bostrom bygger vidare på resonemang från den brittiske filosofen Derek Parfit (1942–2017). I ett exempel ställer han upp tre scenarier för mänsklighetens framtid:

- Evig fred.

- Kärnvapenkrig som utplånar 99% av alla människor.

- Kärnvapenkrig som utplånar 100% av alla människor.

För den som bara tänker på den närmaste framtiden är alternativ 2 och 3 ungefär lika katastrofala, för det är ungefär lika många människor som dör. Men då har man inte tagit hänsyn till framtida generationer. Eftersom de överlevandes ättlingar har potential att bli otroligt många blir skillnaden mellan de dåliga alternativen enormt stor. Om bara några få överlever kan deras efterkommande kanske räknas i kvadriljoner, och att utplåna alla dessa liv vore ofantligt mycket sämre än att bara döda alla nu levande människor.

– Jag tycker att det här är vettiga resonemang. Det är svårt att undgå logiken, säger Karim Jebari, filosof vid Institutet för framtidsstudier i Stockholm.

Även om Karim Jebari själv arbetar med frågor om framtiden är han noga med att påpeka att han inte skulle kalla sig själv för longtermist.

Vad är…

Longtermism?

Ett synsätt som poängterar att den långsiktiga framtiden är en av de viktigaste moraliska prioriteringarna i vår tid. Ibland kallas det på svenska, lite mindre precist, för ”långsiktighet”. Inom strong longtermism går man längre och säger att framtiden är den allra viktigaste moraliska prioriteringen. Longtermism har även kommit att beteckna en subkultur eller en ideologi som driver dessa frågor.

Effektiv altruism?

En rörelse som lutar sig mot evidens och rationella övervägningar för att göra så mycket gott som möjligt. Många anhängare väljer att avlägga löften om att löpande donera en viss andel av sin inkomst till effektiv välgörenhet. Rörelsen sysslar också med karriärrådgivning för att hjälpa människor att hitta arbeten som gör ett positivt avtryck i världen. Earning to give handlar om att satsa på att skaffa sig så stor inkomst som möjligt för att kunna donera desto mer, snarare än att arbeta direkt med välgörenhet eller opinionsbildning.

Existentiell risk?

Händelser eller teknologier som kan utplåna mänskligheten eller göra framtiden permanent dålig. Några av de risker som studeras är artificiell intelligens, vissa sorters potentiell nanoteknologi, syntetisk biologi, kärnvapenkrig och klimatförändringar.

– Longtermister gör också andra antaganden än att framtiden är viktig. De säger att det är mer effektivt att rikta om resurser som vi använder till att motverka lidande i dag, och använda dem till sådant som ska gynna framtida människor, säger Karim Jebari.

Största möjliga nytta

Bedömningarna av vad som är mest effektivt grundas på beräkningar av väntevärden, där sannolikheten för ett visst utfall multipliceras med effekten. Säg att det är låg sannolikhet för att något inträffar, men att det potentiellt skulle kunna förhindra miljarder lyckliga människoliv att uppstå i framtiden. Då blir slutsatsen att det ändå är viktigare att stoppa det scenariot än att ta itu med något mer närliggande som har akuta konsekvenser i dag men gör mindre skada på lång sikt.

Inom effektiv altruism görs också avvägningar för att försöka göra största möjliga nytta i världen. Det finns många exempel på biståndsprojekt som gjort begränsad nytta eller rent av orsakat problem. Genom att ta en noggrann titt på vad som faktiskt fungerar går det att rikta insatserna bättre, är tanken. Något som får väldigt höga poäng i sådana utvärderingar brukar vara att dela ut myggnät i malariadrabbade områden.

– Om du har en hårdnackad longtermism-analys skulle du hellre ha AI-forskning än myggnät, om AI-forskningen minskar den förväntade risken för mänskligheten, säger Karim Jebari.

Området säker artificiell intelligens har pekats ut som mycket viktigt av dem som arbetar med existentiell risk. Det värderas också högt inom longtermismen.

– Mycket av det handlar inte om nuvarande AI-program, utan om tänkbara framtida superintelligenser som kan bli väldigt farliga, säger Anders Sandberg.

AI hot mot mänskligheten?

Han ser argument för att sådana artificiella superintelligenser, om de uppkommer, skulle kunna bli ett hot mot mänskligheten. Därför gäller det att se till att den AI som utvecklas är till nytta och inte kan bli ett hot.

Bild: Getty images

Farhågan är alltså att prioriteringen leder till att en summa som kan läggas på att rädda ett barn från malaria i stället läggs på att skydda många fler barn från att utplånas av en potentiell framtida AI.

Debatten om longtermism fördes först i effektiv altruism-forum på nätet. En del av kritiken fokuserar på den matematiska grunden. Uppskattade sannolikheter som är mycket små multipliceras med en uppskattad skada som kan vara oerhört stor. Hur stor en uppskattad skada blir är dessutom en fråga om värderingar, men de värderingarna döljs bakom siffrorna. Osäkerheterna i olika grundantaganden gör också att det inte är uppenbart vad resultatet betyder.

– Jag anser att för de flesta åtgärder vi kan göra är osäkerheten så hög att vi inte kan säga om det minskar risken eller ökar den, säger Karim Jebari.

Det är inte heller uppenbart hur sådana beräkningar ska förstås i en komplex politisk verklighet. Eric Brandstedt är docent i praktisk filosofi och forskar vid Lunds universitet. Han menar att longtermismen behandlar frågor som är politiskt relevanta men missar att hantera dem som politik.

– Jag tycker att det är en påtaglig risk inom de här tankeströmningarna att de framställer olika moraliskt och politiskt kontroversiella frågor som okontroversiella och vetenskapliga. Att vi kan räkna oss fram till hur mycket vi bör satsa på AI och annat jämfört med till exempel klimatet.

Eric Brandstedt jämför med hur ekonomer ofta har räknat på optimala tillväxtkurvor, och menar att longtermismen, precis som mycket ekonomiskt tänkande, är utilitaristisk. Utilitarismen är en moralisk doktrin som går ut på att handlingar ska avvägas så att de leder till största möjliga lycka eller välbefinnande hos så många som möjligt.

– En vanlig invändning mot utilitarismen är att den inte respekterar individer och individers rättigheter. Den kan ge skäl för att offra individer om det behövs för att göra det så bra som möjligt för många fler, säger Eric Brandstedt.

I utilitaristiska beräkningar av framtidens värde är den grundläggande enheten alltid individens nivå av välbefinnande. Ändå hanteras ofta individerna som delar av en total befolkning och försvinner i ett genomsnitt.

Rättvisa mellan generationer

Det är ju heller inte så att longtermismen är det enda sättet att förhålla sig moraliskt till framtiden. En filosof med ett annat perspektiv var John Rawls (1921–2002).

– Han formulerade det i termer av rättvisa. Det finns en kostnad av att investera för framtiden, och det är att de resurserna hade kunnat användas för att öka konsumtionen för dem som har det sämst i dag, säger Eric Brandstedt.

De här tankarna har sedan länge varit ett eget forskningsfält, teorin om rättvisa mellan generationer.

Eric Brandstedt menar att bristen på politiska resonemang i longtermismen hänger ihop med att den kommer ur en renodlad moralfilosofi utan politisk teori. Rötterna finns också i effektiv altruism som utgår från individuellt beslutsfattande.

– Om jag vill ägna mig åt välgörenhet, hur ska jag då göra så mycket nytta som möjligt och agera rationellt i altruistisk omsorg. Det är något helt annat än hur samhället bör utformas, säger Eric Brandstedt.

Det här är vanlig kritik mot effektiv altruism. I stället för att förändra de strukturer som ger upphov till fattigdom och orättvisor fokuserar rörelsen på att samla in pengar till riktade insatser. De missar då allt som har att göra med frågor om demokrati, makt och rättvisa.

Det finns miljarder dollar i organisationer inom effektiv altruism. De stöttar såväl projekt i fattiga delar av världen som forskning om existentiell risk. Longtermismens anknytning till effektiv altruism ger den alltså möjlighet att påverka flödet av stora summor pengar. Talet om att väga malariaoffer mot AI-forskning blir då mer än en teoretisk fråga.

Bild: Getty images

Longtermismens belackare anklagar den för att vilja ta från de fattiga och ge till de rikas favoritprojekt. En av de mest högljudda kritikerna, filosofidoktoranden och debattören Émile Torres, har gått så långt som att kalla longtermismen för en ny form av rashygien. Hen grundar det dels på att longtermism kan användas för att prioritera bort människor i mindre privilegierade delar av världen, men också på longtermismens kopplingar till transhumanismen och den rörelsens ambition att förbättra människan.

Det här är en helt annan typ av debatt än filosofer är vana vid. Den tycks inte vara något de själva har varit beredda på.

– Det har varit lite av ett gäng filosofinördar som har suttit och hittat rationella slutsatser av olika utgångspunkter. Sedan har de inte uppmärksammat att när man kommunicerar ut det kan det tas emot på ett annat sätt, säger Eric Brandstedt.

Efter att ha tagit del av debatten framstår longtermisternas egna resonemang som försiktigare än man skulle kunna tro. William MacAskill poängterar att han inte tycker att mänskligheten ska satsa allt på ett enda sätt att tänka. I sin bok skriver han att etiska resonemang är så svåra att det är osäkert vad som är bäst, och att vi därför bör väga samman olika moraliska synsätt som bas för vårt handlande.

Enligt Vilhelm Skoglund, som är engagerad i ledningen för två olika effektiv altruism-organisationer i Sverige, är i stort sett alla inom rörelsen eniga om att det är viktigt att tänka både på närliggande problem och det långa perspektivet:

– Det handlar mer om att försöka förstå vad man tycker känns mest pressande så att man kan göra så mycket gott som möjligt, skriver han i ett mejl.

Vilhelm Skoglund är lite bekymrad över hur longtermismen har påverkat bilden av effektiv altruism, eftersom han tycker att det drar bort fokus från centrala frågor. Han påpekar att global fattigdom fortfarande är det område som flest inom rörelsen är intresserade av och värderar högst.

Moralfilosofen Peter Singer, som skrev om de moraliska cirklarna, har uttryckt liknande invändningar mot longtermism. Han befarar att framtidsperspektivet gör det svårare att värva människor till att minska lidandet hos människor och djur i dag.

Longtermism och klimatet

Samtidigt som longtermismen får mothugg finns det många anledningar att tänka på framtiden. Som mänsklighet har vi många viktiga frågor att ta tag i och det gäller att hitta lösningar som fungerar i längden.

– Vi har en mycket lång framtid om vi sköter våra kort rätt. Det är en tanke som medför väldigt stort ansvar. Longtermisterna kan hjälpa oss att justera våra perspektiv, säger Karim Jebari.

Själv skriver Karim Jebari en bok om klimatkrisen och mänsklighetens framtid. Han påpekar att många pratar om klimatet som en fråga för de närmaste decennierna. Men även om vi lyckas reducera utsläppen till noll innan 2050 måste vi hålla kvar dem på noll under tusentals år för att inte rubba balansen igen. Sådant har mycket stora konsekvenser och är värt att fundera på i ett långt perspektiv.

I praktiken kan det också vara så att det ofta är precis samma handlingar som gynnar världen i dag som samtidigt minskar risken för att mänskligheten råkar ut för någon total katastrof.

– Det kan vara till exempel att försöka förhindra kärnvapenkrig genom nedrustning, eller att förebygga pandemier. Det är ingen uppoffring för nuvarande generation, det är bra för oss också, säger Eric Brandstedt.

Longtermismen är ganska ny, och det återstår att se åt vilket håll den utvecklas. Eric Brandstedt tycker att longtermisterna är en lite för smal krets som skulle kunna ha mer utbyte med tänkare inom andra områden.

– Politisk filosofi och teorier om internationell rättvisa och klimaträttvisa finns inte alls med i MacAskills bok. Jag tycker att longtermisterna skulle vara betjänta av att jobba mer tvärvetenskapligt. Då kanske de också skulle bli mindre politiskt naiva, säger Eric Brandstedt.

Här forskas om framtiden

Longtermism har utvecklats vid University of Oxford. Den har koppling till övrig forskning om långa tidsperspektiv och existentiell risk, som har växt fram i ett löst nätverk av olika institut.

Future of humanity institute

En del av filosofiska fakulteten vid University of Oxford. Grundades 2005 av Nick Bostrom och leds av honom. Forskning om makrostrategi, AI-säkerhet, AI-reglering och biosäkerhet.

Centre for the study of existential risk

Grundades vid University of Cambridge 2012 av filosofen Huw Price, astronomen Martin Rees och Skype-miljardären Jaan Tallinn. Forskning om existentiell risk, med mer praktisk inriktning än Future of humanity institute. Bland externa rådgivare finns filosofen Peter Singer och fysikern Max Tegmark.

Future of life institute

Fristående tankesmedja, Massachusetts, USA. Grundades 2014 av fysikern Max Tegmark och Skype-miljardären Jaan Tallinn med flera. Forskning om existentiella risker. Arbetar med lobbying och delar ut forskningsanslag. Har gett pengar bland annat till Future of humanity institute och Centre for the study of existential risk. Viktiga donatorer: Elon Musk, Vitalik Buterin (grundare av kryptovalutan Ethereum).

Global catastrophic risks institute

Amerikansk tankesmedja, grundad 2011 av forskarna Seth Baum och Tony Barrett. Driver ett samarbetsprogram inom existentiell risk. Fokuserar på risker från AI och kärnvapen. Seán Ó hÉigeartaigh från Centre for the study of existential risk är en av dess rådgivare.

Mimer

Ny forskargrupp vid Institutet för framtidsstudier i Stockholm. Grundad av Karim Jebari och Anders Sandberg. Finansieras genom organisationen Effective giving, som utvärderar forskning åt donatorer som vill stötta arbetet med olika problem som världen står inför.

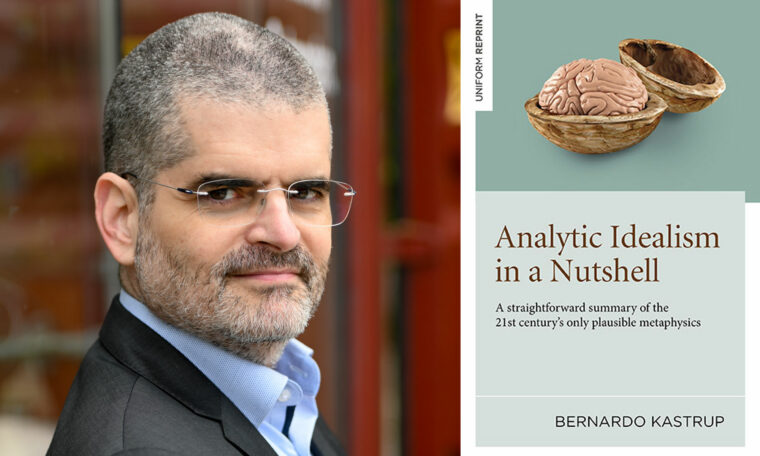

De formulerade longtermismen

De två filosoferna som myntade uttrycket longtermism har skrivit var sin bok som riktar sig till en bred läsekrets.

Vad framtiden förtjänar: Att planera för en miljon år

William MacAskill, 2022 (på svenska 2023)

Vi bör ta hänsyn till framtidens människor, för deras liv är lika verkliga som våra, menar William MacAskill i sin bok What we owe the future, som kom på svenska i april 2023. Mänskligheten skulle kunna finnas kvar oerhört länge, och då är de framtida människorna många fler än alla som hittills har levat. Det är möjligt att vi lever i en tid då det är extra betydelsefullt att fatta rätt beslut för att säkra en god och lång framtid, resonerar författaren.

The precipice

Toby Ord, 2020

The precipice betyder avgrunden eller stupet. Det finns naturliga hot, till exempel om en stor asteroid skulle komma på kollisionskurs med jorden. Samtidigt har vi tillskansat oss verktyg för att förgöra oss själva. Att avvärja de här hoten är oerhört viktigt, anser Toby Ord, eftersom vi annars förstör möjligheterna för framtidens människor.