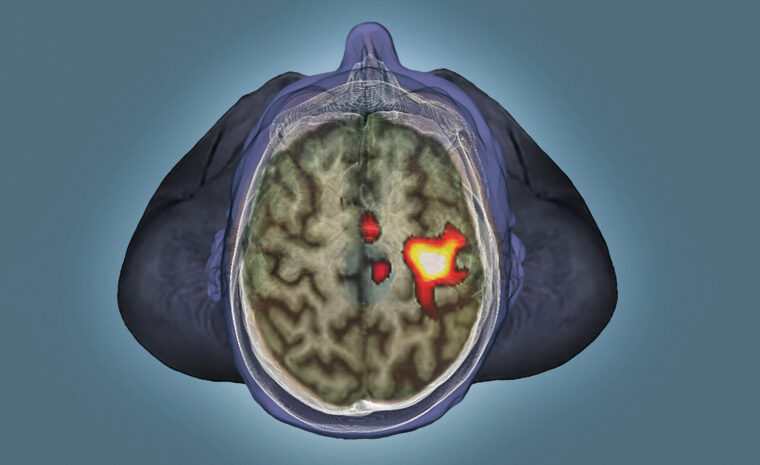

Forskare översätter hjärnaktivitet till ord

Tankeläsning är inte längre science fiction. I en ny studie översätter forskare hjärnaktivitet till ord – med hjälp av AI, magnetkameror och podcasts.

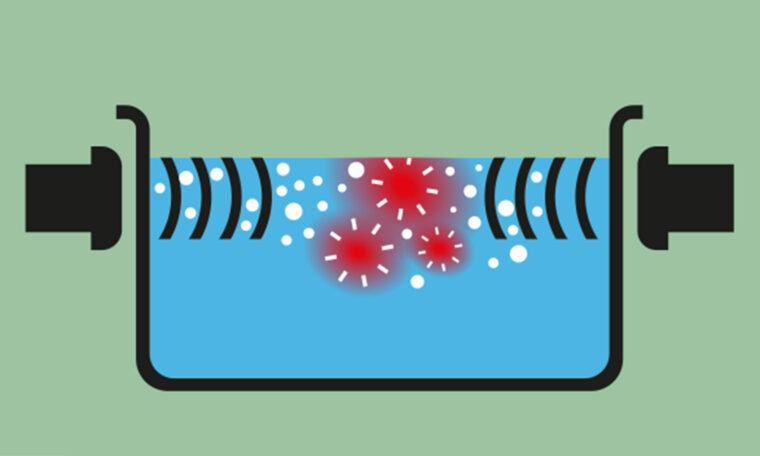

Deltagarna lyssnade på podcasts samtidigt som deras hjärnor skannades med hjälp av en magnetkamera.

Bild: Getty images

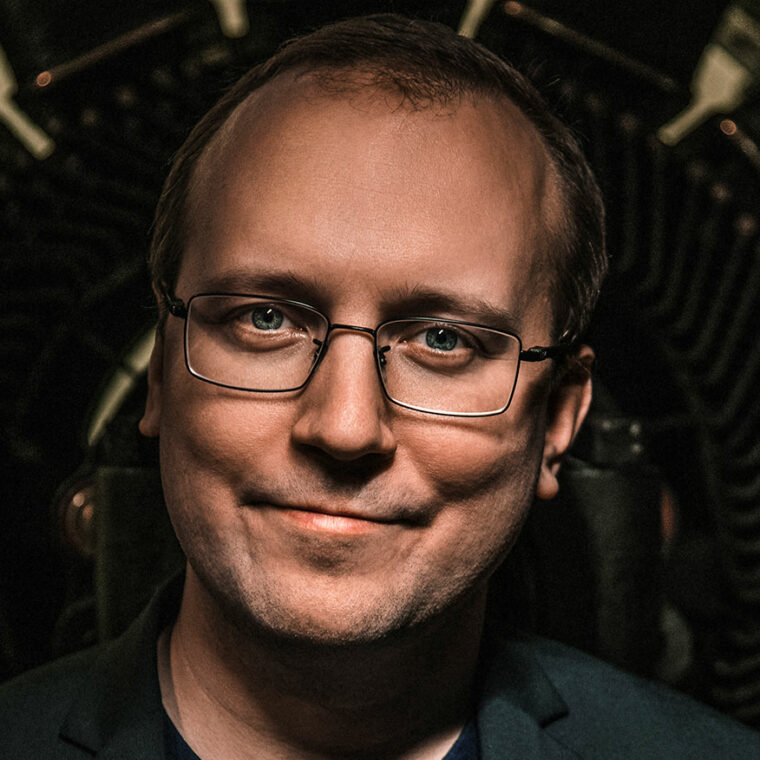

Nu har forskare utvecklat ett AI-system som kan rekonstruera innehållet i en berättelse genom att titta på hjärnaktiviteten hos den som lyssnar. Den tvärvetenskapliga forskningen blandar neurovetenskap och datavetenskap och leds av Alexander Huth vid University of Texas at Austin.

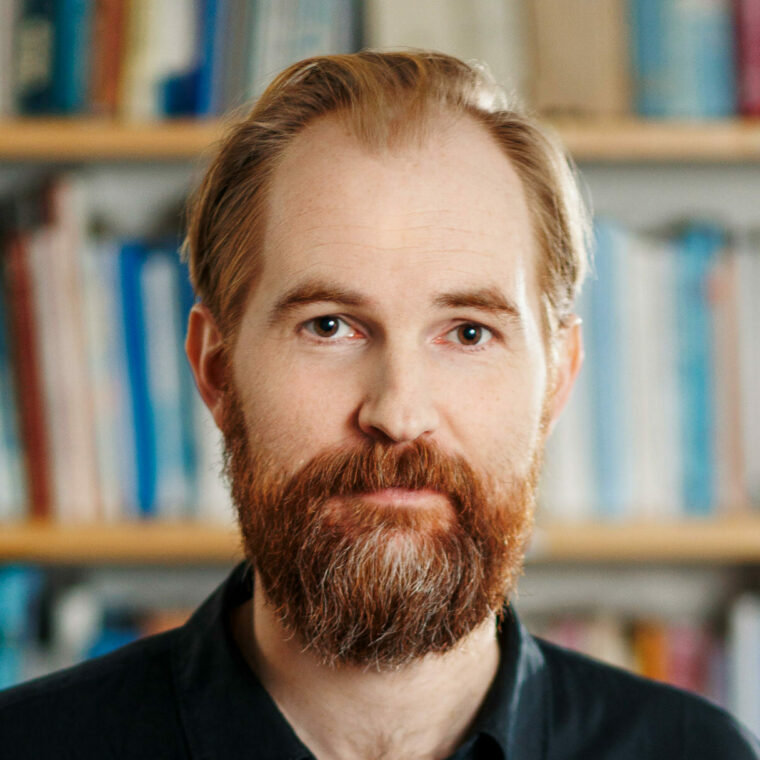

Foteini Liwicki forskar inom maskininlärning och hjärnanalyser vid Luleå tekniska universitet och har följt Alexander Huths forskning länge.

– Det är en väldigt bra studie, det är ett steg mot att avkoda inre tal, säger Foteini Liwicki.

Bild: Linda Alfredsson / LTU

Hennes egen grupp forskar inom samma fält, och kombinerar tekniker för att försöka förbättra avkodningen av enstaka ord. Tidigare studier från andra grupper har också visat att det går att fånga upp vad en person tänker genom att sätta elektroder i hjärnan som känner av de motoriska nervsignaler som aktiveras när ett ord sägs eller försöker sägas.

Bygger på maskininlärning och språkmodeller

Avkodaren i den nya studien, som publicerats i Nature Neuroscience, kräver ingen kirurgi, utan är i stället baserad på maskininlärning och klassiska språkmodeller. Grundidén är att jämföra genererade ordsekvenser med en persons hjärnrespons och på så sätt kunna rekonstruera vad personen har hört i en berättelse. Språkmodellen som används i avkodaren är en version av GPT.

För att träna avkodaren har forskarna låtit försökspersoner lyssna på 16 timmar av podcasts medan deras hjärnor har skannats med hjälp av en magnetkamera. De olika bilderna på hjärnan har sedan parats ihop med vad personerna lyssnade på när bilden togs, varje bild motsvarar ungefär 20 ord.

I själva experimentet har sedan försökspersonerna lyssnat på en ny berättelse medan deras hjärnor skannats med magnetkameran. Avkodaren har genererat gissningar på vilka ordsekvenser de kan ha hört, och förutspått hur en magnetkamerabild av hjärnan i så fall skulle se ut. Den genererade bilden jämförs med den verkliga och dåliga gissningar förkastas tills bilderna är nästan identiska. Resultatet blir en rekonstruktion av vad berättelsen handlade om.

Avkodar betydelsen av ordet

Men det är inte ord som forskarna avkodar. I stället tolkas den semantiska delen av det som sägs, själva betydelsen av orden. Till exempel tolkar avkodaren ”I don’t have my driver’s license yet” (jag har inte fått mitt körkort än) som ”she has not started to learn to drive yet” (hon har inte lärt sig köra än). Orden skiljer sig men budskapet är detsamma.

Att det inte krävs ord blev ännu tydligare när försökspersonerna fick titta på en kort stumfilm. Trots att den animerade filmen inte hade någon dialog kunde avkodaren rekonstruera vad försökspersonerna sett. Den klarade till och med av att tolka innehållet i en berättelse som försökspersonerna ombads berätta tyst för sig själva, i huvudet.

Så är det verkligen språk som forskarna har lyckats avläsa, eller är det i själva verket tankar? Alexander Huth menar att det är något djupare än ord som avkodaren fångar upp.

– Vi översätter det till språk, men experimentet med stumfilmen visar att tankarna inte nödvändigtvis behöver vara verbaliserade för att kunna avläsas, säger Alexander Huth.

Hjälp vid afasi

Förhoppningen är att tekniken i framtiden skulle kunna hjälpa personer som förlorat talförmågan efter till exempel en stroke. Men det finns svagheter. En magnetkamera är knappast smidig, dessutom tar avkodningen lite tid.

– Det vore enklare om vi kunde förlita oss på något mer mobilt, som ett headset. Något som är lätt att bära och starta, och som kan tolka hjärnaktiviteten i realtid, säger Foteini Liwicki.

En annan svårighet är att avkodaren inte kan användas på en ny person utan att först samla in många timmars träningsdata från den individen. Våra hjärnor är helt enkelt för olika för att samma data ska kunna användas. Foteini Liwicki tror att det kommer att bli möjligt i framtiden, när vi förstår bättre hur det inre talet fungerar, men menar också att det inte är där som resurserna bör läggas.

– Om vi skulle kunna hjälpa en enda person med vår teknik så är det bra nog. Först när vi har en bättre precision på individnivå kan vi börja sikta mot den universella, säger Foteini Liwicki.

Rätten till mentalt privatliv

Tekniken väcker också etiska dilemman: Hur bra kan den bli och vad händer om den skulle missbrukas? Även om det scenariot verkar ligga långt fram i tiden visade forskarna i studien att försökspersonerna kunde sabotera avkodaren genom att inte samarbeta. Till exempel fick de rabbla olika djur tyst i huvudet eller tänka på en annan berättelse under experimentet. Direkt blev avkodarens förslag mycket sämre.

Trots det understryker forskarna bakom experimentet vikten av ”mind privacy”, alltså rätten till ett mentalt privatliv. De menar att även om tekniken inte är där än är det viktigt att få ett regelverk på plats som gör tydligt vad data får användas till. Foteini Liwicki håller med.

– Självklart måste vi skydda tekniken från personer som skulle vilja missbruka dem, precis som vi gör med vapen. Vi ger inte vapen till personer som vill använda dem för att döda. Men jag vill understryka att AI:n själv inte är ond, utan det är användarna som kan använda den till fel saker, säger Foteine Liwicki.