Mänsklig AI-röst ökar misstänksamheten

Pratar jag med en människa eller en maskin? När AI blir mer människolik ökar vår misstänksamhet och förtroendet påverkas, enligt AI-forskaren Jonas Ivarsson.

Det blir allt svårare att avgöra om rösten i luren är mänsklig eller en AI.

Bild: Getty images

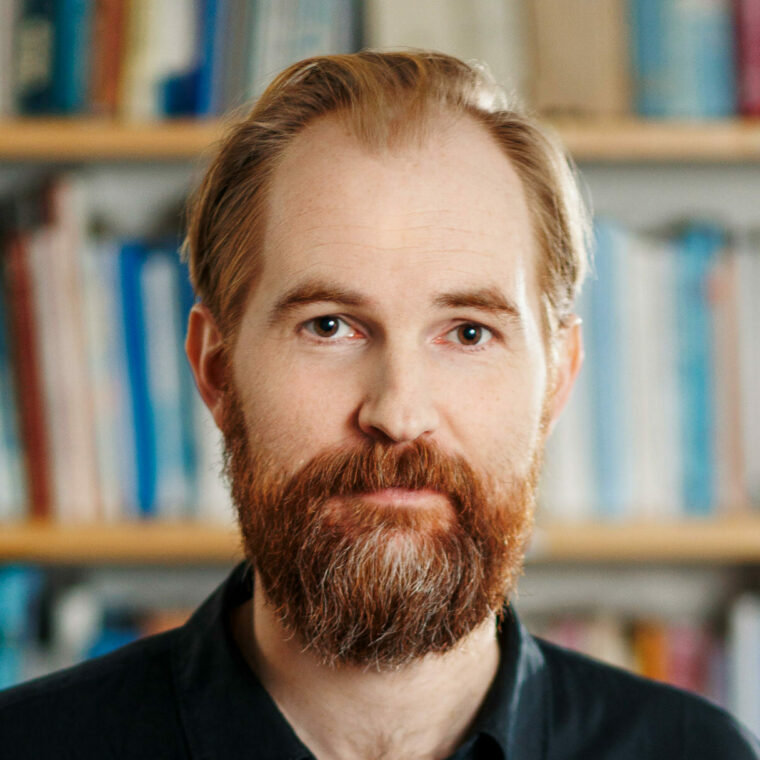

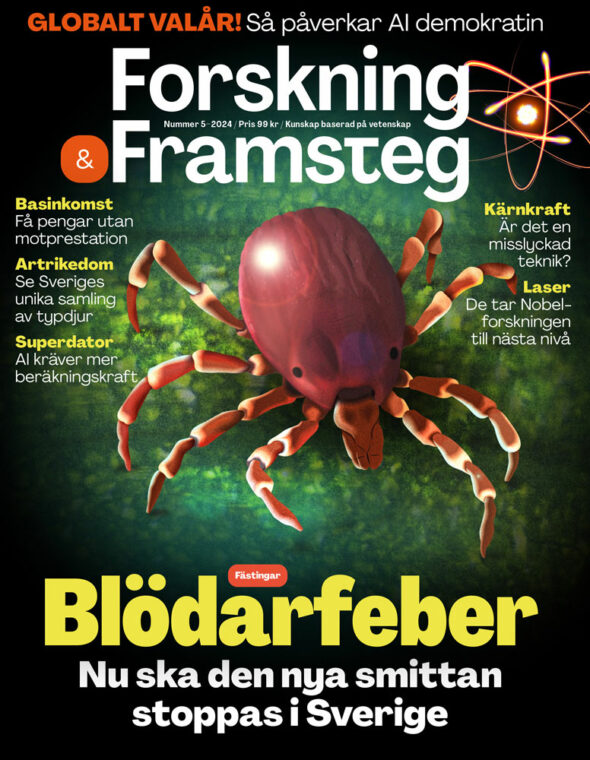

Jonas Ivarsson är professor i informatik vid Göteborgs universitet och forskar om förtroende i relation till AI. I en nyligen publicerad studie har han tillsammans med kollegan Oskar Lindwall, professor i kommunikation, undersökt hur människor reagerar på människoliknande AI-röster.

Studien visar att när AI-röster blir allt mer människolika blir det svårare att avgöra om det är en människa eller en maskin i andra ändan. Det skapar i sin tur en ökad misstänksamhet och förtroendet för dem vi pratar med påverkas.

Bild: Göteborgs universitet

– Vad gör det med oss när vi inte vet om det är en maskin eller en vän i luren? Det blir problematiskt om misstänksamhet gör att vi hela tiden tror att någon försöker lura oss, säger Jonas Ivarsson.

AI spelar förvirrad

I studien jämfördes bland annat samtal där en människa ringer och beställer en tjänst och får tala med en bot, med en liknande situation där den som svarar är en människa.

Misstanken om att den mänskliga rösten kunde vara en robot påverkade hur samtalet uppfattades.

– Man börjar lyssna efter tecken som kan avslöja att det är en dator. Det kan vara en paus eller ett sätt att formulera sig som gör att man börjar tolka samtalet utifrån bilden av att det är ett tekniskt system, fast det är en människa i andra ändan.

Eftersom utvecklingen går mot allt mer människolika AI-system blir det samtidigt svårare att höra om det är en AI. Ett av systemen i studien låtsades till exempel vara en äldre förvirrad man. Det visade sig att det kunde ta lång tid innan den mänskliga motparten förstod att det var ett tekniskt system.

Kan utnyttjas av bedragare

– När en AI har en röst börjar vi att tillskriva den egenskaper. Vi drar slutsatser om kön, ålder, socioekonomisk bakgrund och liknande. Det blir då svårare för oss att se tecknen som avslöjar att det är en dator vi interagerar med, säger Jonas Ivarsson.

En lösning är att AI:n ger någon typ av signal om att det är just en AI. En annan är att rösten är medvetet syntetisk så att det hörs att det inte är en människa.

Inom EU pågår arbetet med en reglering av AI och vilka krav som ska ställas på systemen.

– Regler kan fungera för seriösa aktörer, men det finns också bedragare, påpekar Jonas Ivarsson och förklarar att det i dag räcker med tre sekunders inspelning för att skapa en falsk kopia av en röst.

Även video kan fejkas

Problematiken gäller inte bara röstsamtal utan även video genom så kallade deep fakes, där AI utnyttjas för att skapa falska filmer. Jonas Ivarsson har tidigare utforskat hur omgivningen reagerar genom att skapa en falsk film med sig själv.

– Det var ingen som hörde av sig eller sa att det var fejk. Inte ens min fru tyckte att det var konstigt. Systemet har kommit till den nivån att om vi inte förväntar oss att en film kan vara syntetisk så är det lätt att bli lurad.